Capturing the Temporal Dependence of Training Data Influence

Review

| 닉네임 | 한줄평 | 별점 (0/5) |

|---|---|---|

| 동까스 | 학습에서 언제 학습되었는가가 데이터 영향력을 좌우한다는 관점이 생각해보지 못한 포인트로 매우 신선함. 데이터 영향력이라는 개념도 처음 알게 되었는데 일종의 데이터 Ablation study를 통해 해당 데이터의 영향력을 측정한다니.. 해당 논문의 백그라운드만으로도 알아가는게 많은 논문 | 4.5 |

| 마스킹테이프 | 아이디어는 직관적인데, 그것을 확인하는 방식이 인상적임. 직관적인 아이디어를, 테크니컬하게 잘 풀어낸 논문이라고 생각함. 학습 경로라는 표현이 생각보다 많은 인사이트로 이어질 수 있을 것 같음. | 4.3 |

| 귤 | 초반 데이터가 더 큰 영향을 미친다는 것은 어느정도 직관적이긴 한데, 이때 사용한 데이터가 학습 전 과정에서 가장 높은 영향력을 유지한다는게 핵심인것 같음. 이 관점에서 보면 모델 성능은 모델의 초기 학습 단계에 투입되는 데이터를 얼마나 품질 좋은 것을 쓰느냐에 따라 많이 달라질듯 싶다 | 4.5 |

| 수면장애 | 시간축까지 고려한 LOO라니, 진짜 머리를 얻어맞은 기분! 전부터 curriculum-learning의 중요성을 인지하고 있으면서도 막상 실험해보면 왜 나만 성능이 안오를까? 라고 생각했는데, 그 이유를 증명해준 논문이에요 실험도 이렇게 야무질수가 없네,,, | 4.4 |

| 이어폰 | 훈련 데이터의 순서가 중요할 거라고는 생각해보지 못했는데 초기 훈련단계의 데이터 선정이 모델에 큰 영향 미침을 알게 됐다. 계산 효율적으로 만들어서 실제적으로 구현한 것도 대단하다 | 4.3 |

| 7일 | 데이터 자체에 대한 perturbation이 아닌 시간축을 함꼐 고려한 발상 자체가 너무 참신하다. 10년가까이 지속된 Influence function을 대체할 수 있는 새로운 접근법이 등장했구나! | 4.6 |

| 사과 | 훈련 데이터의 중요성은 그 전부터도 많이 강조되었지만, 시간별로 데이터를 분리해서 측정한 부분에 이 논문의 Novelty가 크다고 생각함. Vector로 데이터를 시간축에 의해 수학적으로 분석한 점도 의미가 있음. | 4.8 |

TL; DR

- 데이터의 가치는 데이터가 ‘무엇이냐’ 보다 ‘학습 시점에 언제 등장했냐’에 의해 결정된다

- 해당 논문은 학습 경로(trajectory)와 데이터의 등장 시기를 고려하는 새로운 데이터 영향력 정의 TSLOO를 제안함

Summary

- Capturing the Temporal Dependence of Training Data Influence, ICLR’25 Oral | Link

- Citation: 14

Introduction

Background

Data Influence Estimation

- 데이터 영향력 추정(data influence estimation): 특정 훈련 데이터가 모델의 예측 행동에 어떤 영향을 미치는지 이해하기 위한 방법

- 모델의 투명성 및 책임성, AI 저작권 논쟁, 등 여러 분야에서 중요한 역할을 함

- 대부분의 데이터 영향력 추정 기법은 다음의 반사실적 질문(counterfactual question)에 답하는 것을 목표로 함:

→ Q: ‘특정 훈련 데이터가 없었더라면 모델의 행동은 어떻게 달라졌을까?’

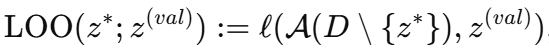

LOO Influence

- Leave-One-Out(LOO): 특정 훈련 데이터 하나를 제거했을 때, 모델의 결과가 얼마나 달라지는지를 측정하는 값

- 앞서 언급한 반사실적 영향(counterfactual impact)은 보통 LOO 영향력으로 정의됨

- 훈련 데이터셋 에서 특정 데이터 를 제거했을 때, 검증 데이터에서의 손실 변화량을 측정

- : 학습 알고리즘

- : 손실 함수

⇒ LOO는 ‘이 데이터 하나가 모델의 최종 예측에 얼마나 기여했는가’를 정량화한 지표

- 기존 LOO 연구의 가정: Permutation-invariant assumption (데이터 순열 불변)

- 학습 알고리즘 은 데이터 순서에 영향을 받지 않는다.

(i.e., 데이터가 어떤 순서로 들어오든 학습 결과는 동일하다.)

- 학습 알고리즘 은 데이터 순서에 영향을 받지 않는다.

- 기존 LOO 연구의 대표적인 예: Influence Function

- 데이터 하나를 미세하게 perturb 했을 때의 영향을 근사하는 방법

Detail

- Q: “이미 다 학습 끝난 이 모델에서, 특정 데이터 z* 가 없었다면 결과가 어떻게 달라졌을까?”

→ 실제로 다시 학습하지 않고, 모델의 최종 파라미터 에서 특정 데이터 하나를 ‘조금 약하게 만들면’ 파라미터가 어느 방향으로 움직일지를 미분으로 근사

- 학습의 과정을 보는 것이 아닌, 최종 모델 결과()를 기반으로 데이터의 영향력을 판단하는 방식

- 데이터 하나를 미세하게 perturb 했을 때의 영향을 근사하는 방법

Motivation

- 하지만 현대의 학습 패러다임(특히 foundation model pretraining)은 더 이상 데이터 순열 불변(permutation-invariant) 가정을 만족하지 않음

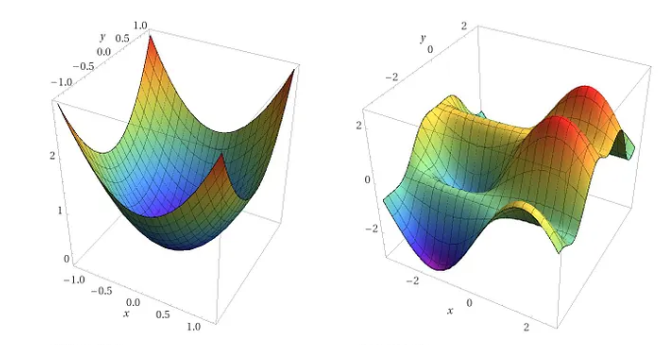

- 이유 1) 신경망 학습은 non-convex 최적화이며, 초기 조건/학습 경로에 민감

- 같은 데이터라도 어떤 순서로 보느냐에 따라 다른 파라미터 궤적(trajectory)로 갈 수 있음

- 이유 2) 여러 단계의 커리큘럼이 존재하고, 수렴하지 않는 학습구조

- 대규모 pretraining 에서는 각 데이터 포인트가 상대적으로 매우 제한된 횟수만 사용되며, 학습이 완전히 수렴하기 전에 종료되는 경우가 많음

→ 이로 인해 데이터가 학습 궤적의 어느 시점에서 등장했는지(timing)가 최종 모델에 미치는 영향이 달라질 수 있음

- 대규모 pretraining 에서는 각 데이터 포인트가 상대적으로 매우 제한된 횟수만 사용되며, 학습이 완전히 수렴하기 전에 종료되는 경우가 많음

- 이유 1) 신경망 학습은 non-convex 최적화이며, 초기 조건/학습 경로에 민감

- 기존에는 permutation-invariant 가정을 그대로 사용하였어서 순서 의존적 영향력(order-dependent influence)을 정확히 반영하지 못함

⇒ 현대 ML학습 동향에 맞는 새로운 영향력 정의가 필요하다!

So in this Paper…

- Trajectory-specific LOO 제안

- RQ: 훈련 데이터 가 번째 iteration에서 등장했을 때 이를 제거하면 최종 모델(검증 loss)은 얼마나 달라질까?

- 기존 LOO를 시간축(timing)까지 확장한 개념

- 다음과 같은 질문에 대답할 수 있게 됨:

- 어떤 데이터가 언제 등장하느냐에 따라 영향력이 어떻게 달라지는가?

- 뒤에 등장한 데이터는 앞 데이터의 영향력에도 영향을 미치는가?

- Trajectory-specific LOO를 계산하기 위해 Data Value Embedding 제안

- Trajectory-specific LOO를 정확히 계산하려면 특정 iteration에서 만 빼고 전체 학습을 다시 돌려야 함 → 비용이 너무 큼

- 그래서 논문은 data value embedding(DVEmb)을 도입해 trajectory-specific LOO를 효율적으로 근사하고자 함

Contribution

- TS-LOO(trajectory-specific leave-one-out) 정의

- 데이터가 몇 번째 iteration에 등장했는지(timing)까지 포함해 데이터의 영향력을 정의

- Data Value Embedding(DVEmb) 제안

- 각 훈련 샘플의 누적 영향(학습 전 과정 전파 효과)을 하나의 벡터로 압축

- 추가적인 재학습 없이 per-sample gradient 저장 + backward 계산 + 압축(랜덤 프로젝션/레이어별 근사)

- 실험 및 결과

- 기존 방법인 Influence Function와 달리 ground-truth LOO 과 높은 유사성을 보임

- 데이터 영향이 초반 high-impact → 중반 low-impact → 후반 재상승의 3구간으로 나타난다는 것을 발견

Methods

Trajectory-Specific Leave One Out Influence (TSLOO)

‘데이터 를 언제() 학습에서 제거했느냐’에 따라 최종 모델의 검증 손실이 얼마나 달라지는지를 측정하는 시간(trajectory) 의존적 LOO

Details

- SGD trajectory

- Counterfactual trajectory

- : 모든 데이터를 원래 순서대로 학습했을 때의 최종 파라미터

- : 시점에서 만 제거하고 이후 동일하게 학습했을 때의 최종 파라미터

- 훈련 데이터 를, 그것이 실제로 사용된 시점 에서만 제거했을 때, 최종 모델의 검증 데이터 에 대한 손실이 얼마나 달라지는가?

- TSLOO는 학습 경로(trajectory)와 timing을 명시적으로 포함함

- 동일한 데이터라도 초반 vs 후반 등장 시 영향력이 달라질 수 있음

- 데이터 간 상호작용까지 반영 가능

- e.g., 어려운 데이터가 후반에 등장하면 초반에 등장했던 데이터의 영향이 증폭/감쇄

→ “데이터 영향력”은 단일 포인트의 고정된 값이 아니라 학습 진행 상태에 따라 달라지는 값

- 하지만 시점에서 를 제거한 반사실(counterfactual) 적 학습을 요구하므로 직접 계산하기에는 매우 비쌈 (→ 그래서 Data Value Embedding 을 제안함 !)

Data Value Embedding

Background

- TSLOO 는 개념적으로는 명확하지만, 특정 시점 에서 데이터 를 제거한 뒤 학습 전체를 다시 돌려야 하므로 정확한 계산은 현실적으로 불가능함

→ 데이터를 실제로 제거하지 않고, “그 데이터가 학습 경로를 따라 어떤 영향을 누적해서 미쳤는가”를 벡터 형태로 요약하자 !! (이것이 Data Value Embedding (DVE))

- 앞서 봤던 TSLOO (아래 식)를 재학습 없이 근사하고자 함

- : 모든 데이터를 원래 순서대로 학습했을 때의 최종 파라미터

- : ts 시점에서 z*만 제거하고 이후 동일하게 학습했을 때의 최종 파라미터

→ 이 둘의 차이를 재학습 없이 빠르게 근사하고자 함

Data Value Embedding

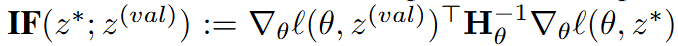

TSLOO 수식에서 (1) 검증 데이터에 의존하는 부분 (2) 훈련 데이터 고유 항을 분리하여 계산하자

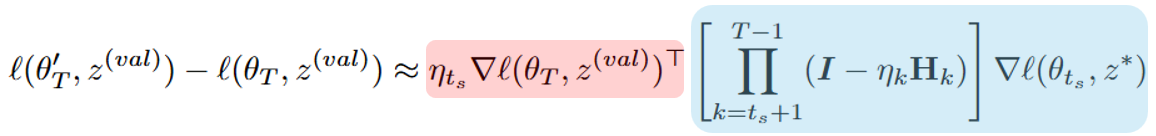

- 앞선 TSLOO 수식은 (1) interpolation, (2) 1차 Taylor 근사 에 기반하여, 다음과 같이 나타낼 수 있음

(1) Interpolation

- 데이터를 완전히 제거한 모델”과 “제거하지 않은 모델” 사이를 연속적으로 이어서 간주하는 방법

- 일반적으로 ‘데이터제거’는 불연속 사건임. 근데 이거를 미분 가능한 연속 변화로 바꿔줌

(2) 1차 Taylor 근사

- 직관: 조금만 바뀌면, 결과도 거의 직선처럼 조금만 바뀐다

- 검증 손실 변화 ≈ (검증 손실의 기울기) × (파라미터가 얼마나 움직였는지)

→ 데이터 하나 제거로 인한 손실 변화는 ‘지금 모델이 민감한 방향’과 ‘그 데이터가 파라미터를 밀어낸 방향’의 곱으로 볼 수 있음

- 직관: 조금만 바뀌면, 결과도 거의 직선처럼 조금만 바뀐다

- 왼쪽 벡터: 검증 데이터 에 대한 최종 gradient

- 이 검증 샘플을 더 잘 맞추려면 파라미터를 어느 방향으로 움직여야 할까?

- 오른쪽 벡터: 훈련 데이터 가 학습 경로를 따라 누적시킨 영향(학습 trajectory에 의존)

- : 데이터 가 그 순간 모델을 얼마나, 어느 방향으로 밀었나?

- : 그때 밀린 효과가, 이후 학습을 거치며 얼마나 살아남았는가?

→ 오른쪽을 미리 계산해서 벡터로 저장

(오른쪽이 미리 계산되어있으면, 어떤 이 들어오더라도 내적만 하면 됨)

⇒ TSLOO(최종 손실 변화)는 “검증 데이터의 최종 gradient”와 “훈련 데이터 하나가 학습 궤적을 따라 누적시킨 영향”의 내적으로 근사된다

- Data Value Embedding(DVEmb): TSLOO 근사식에서 훈련 데이터 고유 항을 분리한 벡터

- 가 시점에 들어왔을 때 그 영향이 학습 종료 시점까지 어떻게 누적/ 전파되었는지 하나의 벡터로 압축한 표현

Detail

- 는훈련 데이터 가 시점에 모델 파라미터 에 가한 영향

∇ℓ(𝜃𝑡𝑠,𝑧∗)이,이후 학습 과정에서 각 단계의 Hessian(곡률정보) 𝐻𝑘Hk와 학습률 𝜂𝑘ηk에 의해

(𝐼−𝜂𝑘𝐻𝑘)(I−ηk Hk) 형태로 반복적으로 변형되면서 학습 종료 시점까지 누적된 전체 영향을 하나의 벡터로 압축한 표현- Hessian(2차 미분): Gradient(1차 미분)이 얼마나 빠르게 변하는지를 나타냄

→ 데이터 하나 z^* 의 gradient 영향이 이후 학습 step들을 거치면서 어떻게 변형((I−ηkHk)) 되는가

- 는훈련 데이터 가 시점에 모델 파라미터 에 가한 영향

- 데이터 하나 가 학습 경로 전체에 미친 누적 영향을 벡터로 표현한 것

→ 이는 학습 과정에서의 해당 데이터가 가지는 가치(value)를 표현함

- 이후 영향력 계산은 검증 gradient와 DVEmb의 dot-product으로 즉시 수행가능함

- 이후 어떤 검증 데이터가 와도, 이 벡터를 다시 계산할 필요가 없음

[Theory] Approximation Error Bound (이론적 보증)

- 이러한 근사가 학습 스텝 수 T가 커져도 (학습이 길어져도) 오류가 폭발하지 않는다는 이론

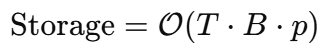

Computation of DBEmb

위에서 정의한 식을 실제로 계산해보고자 함

- Key Idea

- 학습 중 각 샘플의 gradient를 ‘통째로’ 저장하지 않고, 나중에 gradient를 재구성할 수 있는 구성요소(activation, backprop 신호)만 저장 (Step 1)

- 학습 끝(T-1)에서 시작해서 0까지 거꾸로 내려오면서 DVEmb를 재귀적으로 계산 (Step 2)

Step 1: Store Pre-sample training Gradient Information at Each Iteration

Key Idea

학습 중 각 샘플의 gradient를 ‘통째로’ 저장하지 않고, 나중에 gradient를 재구성할 수 있는 구성요소(activation, backprop 신호)만 저장문제 상황

해결 방안

- gradient를 통째로 저장하지 말고 분해된 구성요소만 저장

- 보통 샘플의 gradient는 다음과 같이 표현 가능:

- : 그 샘플의 activation(중간 표현)

- : 그 샘플의 output derivative(역전파 신호)

- : outer product

→ gradient는 “activation × 역전파 신호”로 조립 가능하기 때문에,

“거대한 벡터 대신 , 같은 구성요소만 저장 - 보통 샘플의 gradient는 다음과 같이 표현 가능:

- 큰 모델이라면 구성요소도 크기 때문에, 이를 추가적으로 압축하여 저장

- , 자체도 크므로, 랜덤 프로젝션으로 차원을 로 낮춰 저장

- 정확한 gradient 전체가 아닌 영향력 계산에 필요한 “기하(방향/유사도)”를 유지하고자 함

- gradient를 통째로 저장하지 말고 분해된 구성요소만 저장

Step2: Backpropagating Data Value Embedding

Key Idea

DVEmb는 “미래 step들의 누적 효과”가 들어가서 정방향으로 계산하기 어려움

→ 학습 끝(T-1)에서 시작해서 0까지 거꾸로 내려오면서 DVEmb를 재귀적으로 만들자- 구하고자 하는 것: 각 훈련 데이터가 학습이 끝날 때까지 얼마나, 어떤 방향으로 영향을 누적했는지를 나타내는 벡터 를 구하고 싶음

→ 데이터가 모델이 미치는 ‘최종 영향’은 미래 학습까지 다 반영해야 알 수 있음. 그래서, 마지막 학습 step 부터 과거로 거꾸로 계산하고자 함

해결 방안 (계산법)

- 마지막 step에서는 미래가 없으므로

- DVEmb = 그 시점의 gradient × 학습률

- 조금 앞 step에서는

- 이 데이터의 현재 gradient+ 이후 step들에서 이미 계산된 영향을 한 번에 반영

- 이때 미래 step들의 누적 효과를 하나의 요약 행렬 M 에 계속 저장해 두기 때문에 매번 ‘미래 전체를 다시 계산’하지 않아도 됨

⇒ 미래 학습의 영향을 요약한 상태로, 각 훈련 데이터의 최종 영향 벡터를 거꾸로 계산하는 과정

- 구하고자 하는 것: 각 훈련 데이터가 학습이 끝날 때까지 얼마나, 어떤 방향으로 영향을 누적했는지를 나타내는 벡터 를 구하고 싶음

Experiment

Fidelity Evaluation

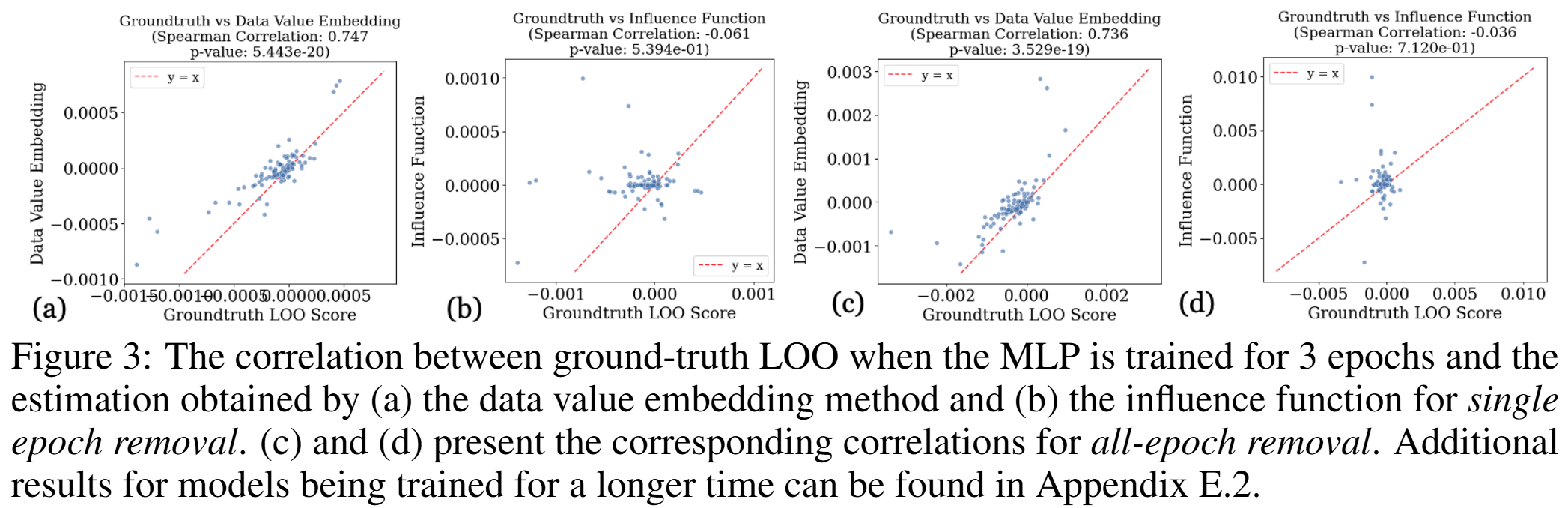

- Data Value Embedding(DVEmb)이 진짜 Leave-One-Out(TSLOO)값을 얼마나 정확하게 근사하는지 확인하고자 함

- DVEmb와 실제로 그 데이터를 빼고 다시 학습했을 때의 영향(ground-truth LOO)와 비교

Setting

- Data: MNIST

- Model: 간단한 MLP (trained with standard SGD)

- Ground-truth LOO: 한 데이터 포인트 를 실제로 제거하여 모델을 다시 학습함. 최종 validation loss 변화 측정

- SGD로 학습된 MLP와 짧은 학습(3 epochs)으로 진행

- Exp setting

- Single-epoch removal (a, b): 데이터 를 특정 epoch 한 번만 제거하고, 나머지 epoch에서는 그대로 사용

→ 특정 데이터가“이 시점()에 빠졌을 때 영향” 을 보고자 함 (TSLOO 세팅)

- All-epoch removal (c, d): 데이터 를 모든 epoch에서 제거

→ 전통적인 LOO와 더 가까운 세팅

- Single-epoch removal (a, b): 데이터 를 특정 epoch 한 번만 제거하고, 나머지 epoch에서는 그대로 사용

표 설명

- 점 하나: 하나의 훈련 데이터 포인트

- x 축: Ground-truth LOO score (해당 데이터의 실제 영향력)

- y 축:

- (a, c) Data Value Embedding이 예측한 영향력

- 데이터가 사용된 시점과 이후 학습 경로를 모두 고려하여 데이터의 영향력을 평가

- (b, d) Influence Function이 예측한 영향력

- 시간 고려 X, 모델의 최종 상태만을 기준으로 데이터의 영향력을 평가

- (a, c) Data Value Embedding이 예측한 영향력

→ 이상적인 경우: 점들이 y = x 축에 올라와 있는 상황

이는 예측값이 실제 LOO와 동일하다는 의미로, 해당 논문이 제안한 ‘데이터 가치 추정이 정확함’을 나타냄

- (a), (c)는 Data Value Embedding과 Ground-truth LOO와의 상관관계를 나타낸 표

- 상관계수가 약 0.74이며, 점들이 대각선 y=x 근처에 밀집되어 있음

→ DVEmb가 Ground-truth LOO를 잘 근사하고 있음

- (b), (d)는 Influence Function과 Ground-truth LOO와 의 상관관계를 나타낸 표

- 상관계수가 0 및 음수이며, 점들이 흩어져 있음

→ Influence Function은 LOO를 거의 설명하지 못함

⇒ 데이터 영향은 최종 모델 상태만으로는 설명할 수 없고, 학습 경로를 따라 누적된 효과로 이해해야 함

- Data Value Embedding(DVEmb)이 진짜 Leave-One-Out(TSLOO)값을 얼마나 정확하게 근사하는지 확인하고자 함

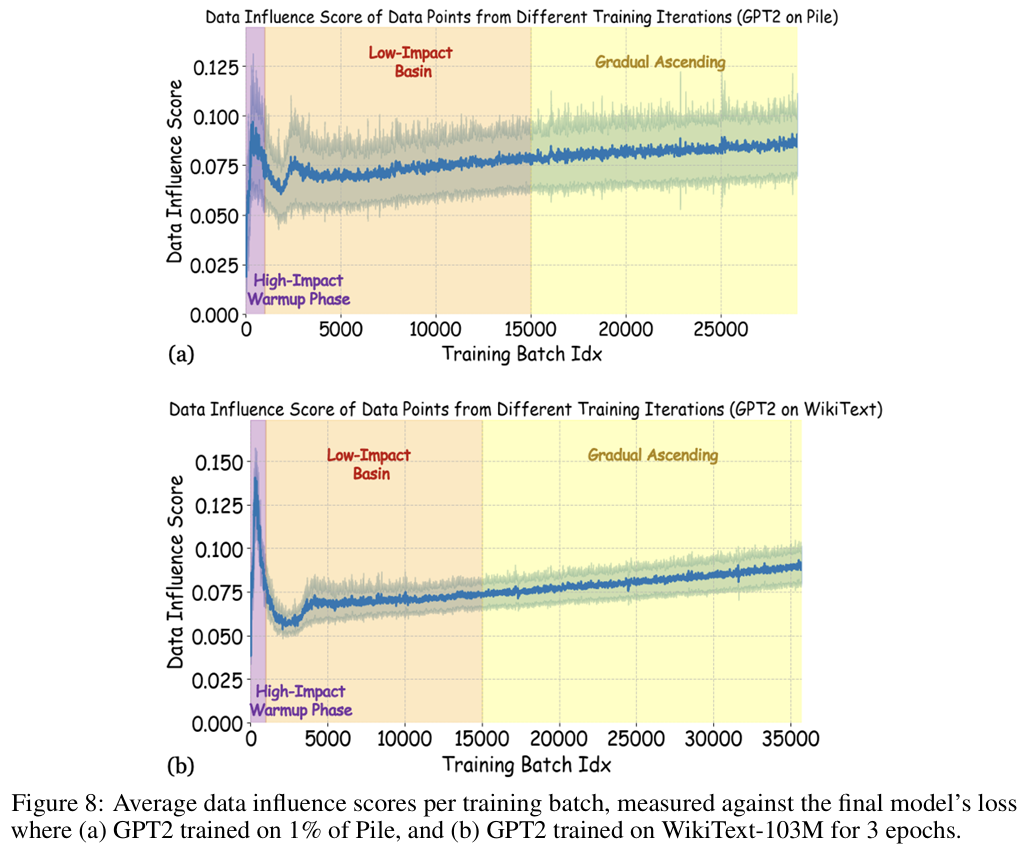

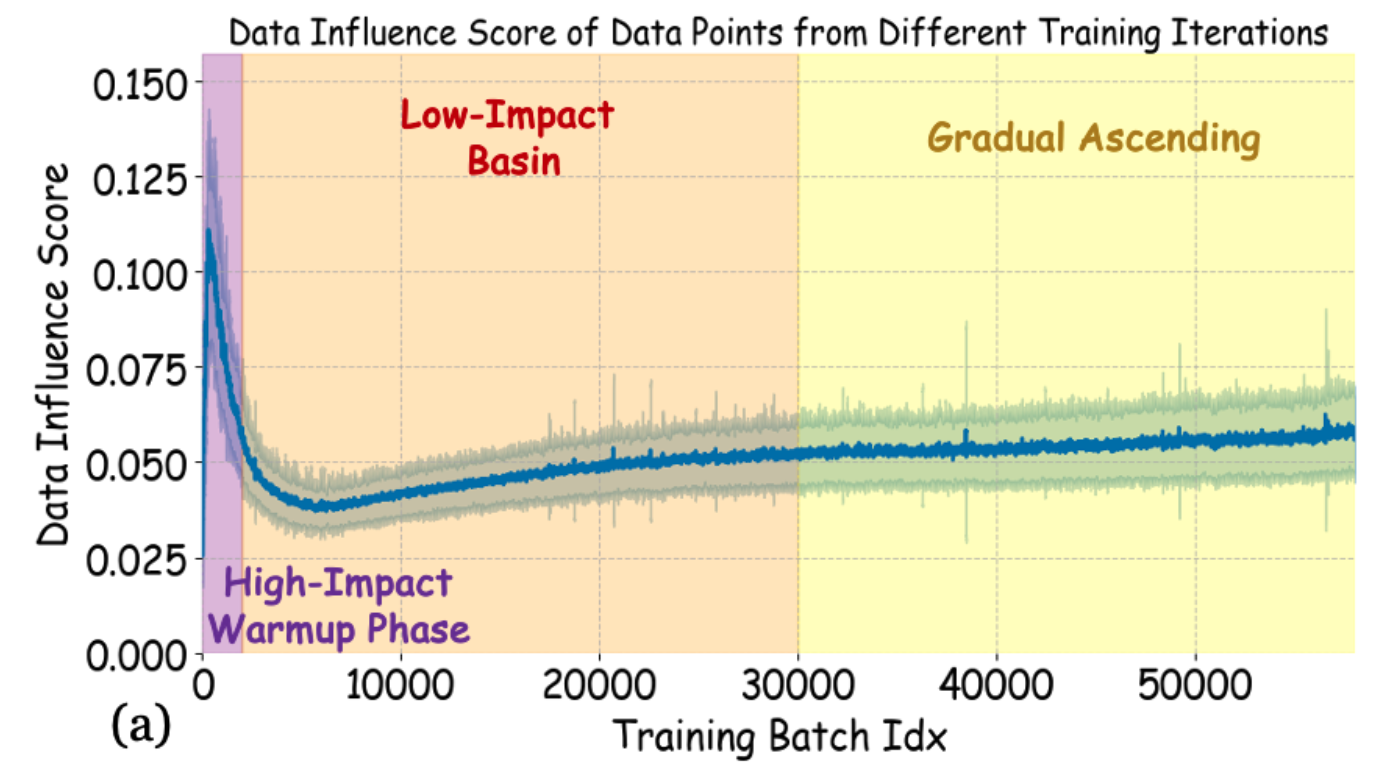

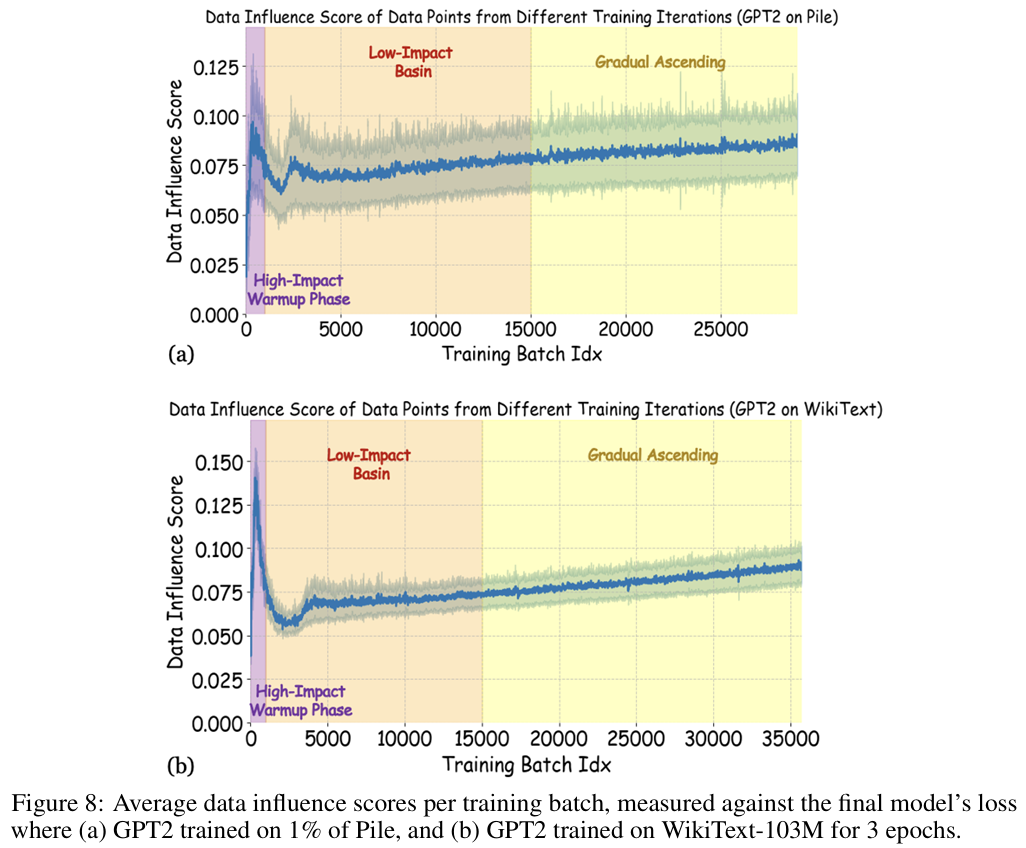

Analyzing Training Dynamics of Foundation Models

- Data Value Embedding(DVEmb)을 활용해 LLM 사전학습(pretraining) 과정에서 데이터의 영향력이 시간에 따라 어떻게 변하는지 분석

- Setting:

- Model: Pythia-410M

- Dataset: Pile (1% subset)

- 규모 약 800GB 텍스트로 이루어진 LLM용 대표적인 pretraining dataset

표 설명

- y축(Influence Score): 훈련 데이터의 Data Value Embedding과, 중간 체크포인트에서의 gradient를 내적한 값

- 모델에 대한 데이터 영향력은 학습 시점에 따라 3가지 구간으로 나눌 수 있음:

- High-impact Warmup Phase (초기 고영향 구간)

- 학습 초반 아주 짧은 구간에 데이터 영향이 비정상적으로 큼

- 모델의 loss가 빠르게 감소하고, 모델의 기본 표현 및 방향성이 결정되는 부분

→ 초기 데이터가 모델 전체 성격을 크게 좌우함

- Low-impact Basin (중반 저영향 구간)

- 데이터 영향력이 전반적으로 낮고 안정적

- 해당 구간의 데이터는 이미 정해진 방향을 따라 미세조정하는 역할

- Gradual Ascent (후반 점진적 상승)

- 학습 후반으로 갈수록 (나중에 등장한 데이터일수록) 영향력이 다시 증가

⇒ LLM 학습에서의 데이터의 가치는 고정된 것이 아니라, 학습하는 시간적 위치에 따라 다르게 작용함

- High-impact Warmup Phase (초기 고영향 구간)

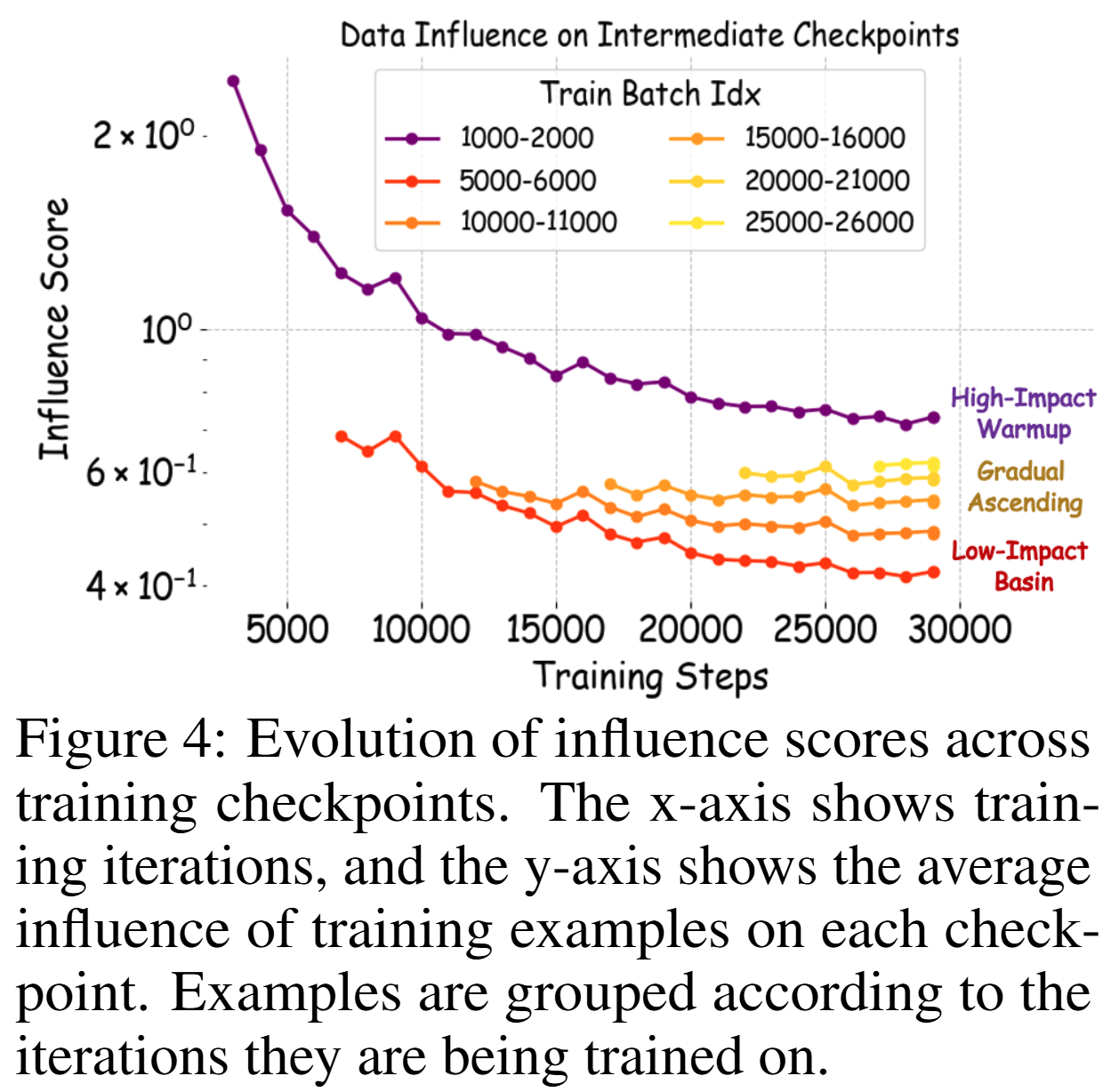

Analyzing Training Dynamics of Foundation Models - Explanation

- 그렇다면 왜 이런 현상이 일어날까? 에 대한 실험

- 왜 학습 초반 데이터는 오래 영향력이 남고, 중간 데이터는 약하고, 후반 데이터는 다시 영향력이 커지는 것인가?

표 설명

- x축: 학습 단계 (iteration)

- y축(Influence Score): 해당 데이터들의 평균 영향력

- 값이 클수록 모델 파라미터에 강하게 남아있음

- Train Batch Idx

- 1000–2000 (보라색): 학습 아주 초반에 사용된 데이터들

- 5000–6000, 10000–11000 (주황/빨강): 학습 중반 데이터들

- 15000–16000, 20000–21000, 25000–26000 (노랑): 학습 후반 데이터들

→ 각 곡선은 ‘그 시점에 학습에 등장한 데이터 묶음이, 이후 학습이 진행되면서 얼마나 영향력을 유지/상실하는가’를 나타냄

Explanation (1): 초기 파라미터 업데이트 효과

- 학습의 아주 초반에는 gradient 크기가 매우 크기 때문에 파라미터가 크게, 많이 움직임

→ 그래서 이 시점에 들어온 데이터는 모델의 기본 방향(초기 구조) 을 결정하게 되고, 이후 학습 내내 그 흔적이 남음

- 보라색 곡선을 보면, 초반에는 매우 높은 influence score을 가짐. 이후 훈련이 진행됨에 따라 영향력이 내려가기는 하지만, 전체 학습 시점을 통틀어서 모든 시점의 데이터보다 영향력이 위에 있음

→ 학습 초반에 사용한 데이터의 영향이 학습 전반에 걸쳐높은 영향력을 유지함(학습 초반에 어떤 데이터를 사용하는지의 여부가 중요하다)

Explanation (2): 이후 데이터에 의한 영향 희석 (Influence Saturation)

- 어떤 데이터의 영향력은 그 뒤에 비슷한 데이터가 계속 나오면 포화(saturation)되어 더 이상 커지지 않고 오히려 줄어들음

- 이미 충분히 배운 내용에 대해서는 이전에 등장한 데이터의 개별 기여도가 점점 희석됨

catastrophic forgetting 과는 다름!

- catastrophic forgetting: 신경망이 새로운 데이터(또는 태스크)를 학습하는 과정에서 이전에 학습한 정보나 능력을 급격하게 잃어버리는 현상

- Influence Saturation 상황 예:

- 초반에 어떤 데이터 가 quantum computing 내용을 가르침 → 그 뒤 학습 과정에서 비슷한 데이터들이 등장

- 모델 입장: ‘아, 이 개념은 여러 예제에서 충분히 배웠기 때문에 초반 데이터 하나에 의존할 필요가 없다’ (기여도 분산)

→ 초반 데이터의 개별 influence score 는 감소, 하지만 그 개념은 사라지지 않음(이게 catastrophic forgetting과는 다른 점임)

- Fig4에서 , 중반 데이터 (빨간색, Low-impact Basin)의 영향력은 계속 감소하는데, 나중에는 학습 후반 데이터보다도 낮아짐

- 미래 데이터에 많이 덮여서 영향력이 더 많이 희석됨

- 그렇다면 왜 이런 현상이 일어날까? 에 대한 실험