Scaling Laws for Precision

Review

| 닉네임 | 한줄평 | 별점 (0/5) |

|---|---|---|

| 마스킹테이프 | 언어 모델 학습 과정의 디테일을 이해할 필요성을 생각하게 한 논문인 것 같음. 평소에 그냥 데이터 관점에서, 어떤 데이터를 주고 어떤 프로세스로 학습시킬지만 고민했는데, 데이터에 따라 선택해야 하는 학습 방법도 고민해야겠다는 생각을 하게 한 논문. 어렵지만 좋았다. | 3.8 |

| 동까스 | 스케일링 관련 논문을 처음 읽어봤는데 실제로 실험할 때, 정밀도와 같은 다양한 하이퍼 파라미터들을 어떻게 설정하는지가 얼마나 중요한지 깨닫게 해준 논문 | 3.8 |

| 귤 | 동일한 파라미터의 모델이더라도, 파라미터가 얼마나 유효하게 쓰이고 있는지 파악하고, 최대한으로 쓰이게끔? 하는것이 모델의 성능을 결정할 수 있을듯. 그리고 성능이 동일하다고 가정했을 때, 정밀도를 낮췄을 때의 모델과 파라미터 수를 줄인 모델이 풀 수 있는 문제가 뭐가 다른지 궁금함. | 4.4 |

| 수면장애 | 정리된 거 봤는데도 어렵다 그치만 평소 Data-centric한 관점인지라 재밌게 읽었음!! 당연히 bit 수가 높을수록 성능이 좋을거라고 생각했는데, “쓸데없이 정밀”할 수 있다니…! 불필요한 데이터마저도 학습해서 그런 거 아닐까요? 데이터 특성에 따라 정밀도가 dynamic해질 수는 없을까요? | 4 |

| 이어폰 | precision이 무작정 높기보다 적당해야 좋다는데, 데이터 분포가 이상적이라면 그래도 precision 높은 게 무조건 좋으려나? fp 설정 건드릴 때 등 실용적으로 활용할 내용이 많아 좋다 | 3.8 |

| 7일 | 추론할 때 더 낮은 정밀도로 양자화 한다는 사실을 처음 알았네…많은 논문들이 BF16으로 실험하는거같은데 FP6, FP8이 최적의 설정이라는걸 실험적으로 보임으로써 추후 실험할 때 써먹을 수 있을거같음. | 4.2 |

| 사과 | 추론할 때, 무조건 높은 정밀도를 사용한다고 해서 좋은 결과가 나오는 것이 아님을 증명한 논문이라 의미가 있는 것 같음. 데이터의 크기가 클수록 높은 정밀도가 필요하기는 하나, 정밀한 것이 항상 최적의 결과가 아님이 확인됨으로써 앞으로의 연구나 실험에서 낮은 정밀도로도 실험이 필요할 것 같음. | 4.7 |

Summary

저자:

cited: 81

TL; DR

언어 모델의 학습 및 추론 시 정밀도(precision)가 모델의 성능과 비용에 미치는 영향을 체계적으로 분석하고, 이를 예측할 수 있는 precision-aware scaling laws를 제시

Background

- 최근 LLM 성능 향상은 주로 스케일링(scaling) 을 통해 이루어짐

- 스케일링: 모델 크기(파라미터 수), 학습 데이터 증가

- 기존 Scaling Law (e.g., Chinchilla, DeepMind’22) 는

- 모델 크기()

- 데이터 크기()

만을 고려하여 성능을 예측함

- 하지만 해당 논문에서는 모델을 어떤 정밀도(precision) 로 학습하고 추론하느냐가 비용과 성능 모두에 큰 영향을 미친다는 것에 주목함!

- e.g., 16비트에서 4비트로 정밀도를 줄이면 그만큼 비용도 줄고 속도도 빨라짐

- 실제 최신 모델들의 추세는 실제로 FP32 → FP16, BF16 → FP8 → FP4 로 저정밀화가 진행 중

- ⇒ Scaling Law 에서 모델, 데이터 뿐 아니라 정밀도도 신경쓰자!

Motivation

RQ1: 얼마나 낮은 정밀도까지 가능한가?RQ2: 동일한 예산이면 어떤 조합이 최선일까? (큰 모델 + 낮은 정밀도 vs 작은 모델 + 높은 정밀도)RQ3: 학습할 때의 정밀도와 실제 추론에서의 정밀도의 관계는?RQ4: 데이터가 많으면 정밀도를 어떻게 조정해야 할까?

Contribution

1. 통합 스케일링 법칙

- 최초로 정밀도를 스케일링 법칙에 통합

- 학습과 추론 모두 고려

- 90% 이상 정확도로 예측 가능

2. Effective Parameters (유효 파라미터 수) 개념 도입

- 낮은 정밀도 = 표현 가능한 정보량 감소

- 이는 파라미터 수가 줄어든 것과 유사한 효과

- e.g., 1B 파라미터 × 8bit = 500M 파라미터 × 16bit (둘이 동일한 표현력!)

- 정밀도 ↔ 파라미터 크기의 trade-off 정량화

3. 낮은 정밀도 학습이 오히려 compute-optimal일 수 있음을 제시

- 스케일링 분석 결과

- 투머치한 정밀도: 16bit 학습은 불필요하게 정밀함

- 너무 낮은 정밀도: 4bit 이하 학습은 표현력 손실 과도

- ⇒ 실험적으로 7~8 bit 수준이 compute 대비 성능 최적화에 가까움

Methods

핵심: 정밀도를 낮추면 파라미터가 줄어드는 것과 같다!

용어

: 토큰 기준 데이터셋 크기

: 파라미터 기준 모델 크기

- 학습 중(Training)에 사용하는

- : 가중치

- : 활성 값

- : 키-값 캐시의 비트 정밀도

- 학습 이후(Inference) 사용하는

- : 학습이 끝난 뒤, 추론을 위해 가중치를 양자화할 때 사용하는 정밀도

- 학습 중(Training)에 사용하는

1. Effective Parameters (유효 파라미터 수)

- 모델은 개의 파라미터를 가지지만, 정밀도가 낮아질수록 서로 다른 값들이 같은 값으로 양자화되고 실제로 구별 가능한 자유도가 감소함

- 즉, 낮은 정밀도 = 일부 파라미터가 비활성화된 것과 동일

Effective Parameter 정의

- : 실제 파라미터 수

- : 정밀도 (bit-width)

- : 정밀도 민감도 상수 (precision sensitivity)

- 높은 정밀도:

-

- (유효 파라미터 수가 실제 파라미터 수와 같음)

- 낮은 정밀도

- 가 빠르게 감소 → 모델 표현력 급격히 제한

- e.g.,

- 1B @ 8bit →

- 1B @ 4bit →

- 가 빠르게 감소 → 모델 표현력 급격히 제한

⇒ 정밀도 감소는 모델 크기 감소와 동일한 효과를 가진다

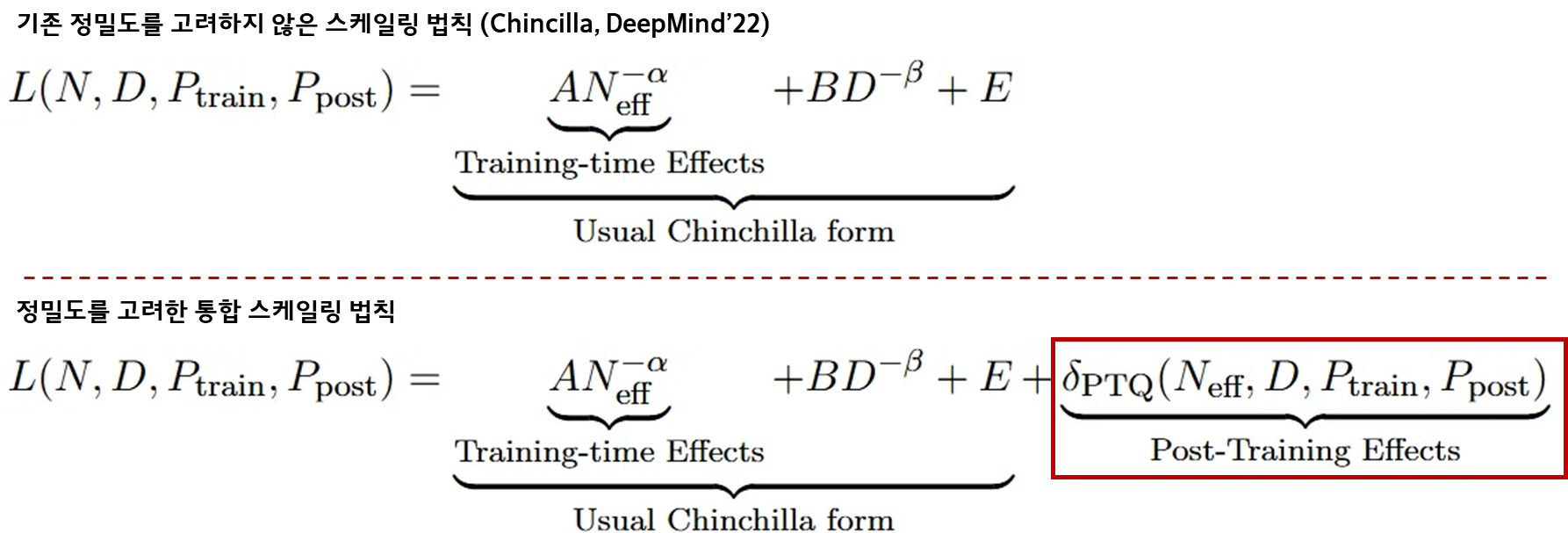

2. Training Scaling Law (Chinchilla 확장)

- 기존 Chinchilla Scaling Law

- 모델의 성능은 모델 크기 과 데이터 크기 로 결정됨

- : 모델 크기 한계로 인한 손실

- : 데이터 부족으로 인한 손실

- : 절대 줄일 수 없는 잔여 손실

- 모델의 성능은 모델 크기 과 데이터 크기 로 결정됨

- 확장 Ver. : 실제 성능은 실제 파라미터 수가 아니라 유효 파라미터 수에 의해 결정됨

- 기존 Chinchilla 방식과 다르게 (유효 파라미터) 로 변경

- 학습 정밀도 이 낮아질수록

→ 모델이 담을 수 있는 유효 정보량 감소

⇒ 결과적으로 가 작아진 것처럼 동작

3. Post-Training Quantization (PTQ) Degradation

- 실제 환경에서 대부분 학습은 상대적으로 높은 정밀도, 추론은 더 낮은 정밀도로 양자화 함!

- 이때 발생하는 성능 저하를 로 정의함

- : 학습이 끝난 모델을 더 낮은 정밀도로 양자화했을 때 추가로 발생하는 손실(성능 저하)

- Gap:

⇒ Gap이 클수록 양자화로 인한 추가 손실 증가 ( ↑)

- Overtraining: 데이터 대비 모델 크기 비율 ()

- Overtraining이 심할수록 즉, 데이터가 모델 크기에 비해 너무 많으면 모델은 미세한 패턴까지 학습

- But, 추론 정밀도가 낮으면 그 미세한 패턴이 저장되지 못함

⇒ Overtraining이 심할수록 ( ↑)

- : 추론 시 정밀도

⇒ 추론 정밀도가 낮을수록 표현 가능한 정보량이 줄어 ↑

- Gap:

- : 학습이 끝난 모델을 더 낮은 정밀도로 양자화했을 때 추가로 발생하는 손실(성능 저하)

- 낮은 학습 정밀도 효과

- 학습을 낮은 정밀도로 했던 모델은 학습 과정에서 이미 표현력이 제한되어 미세한 패턴을 덜 의존하게 됨

⇒ 학습 정밀도 가 낮을수록 로 인한 추가 손실이 덜함!

- 무조건 저정밀 학습이 좋다가 아니라 PTQ로 인한 추가 손실 관점에서는 덜 민감하다는 뜻임 (오해 금지!)

- 학습을 낮은 정밀도로 했던 모델은 학습 과정에서 이미 표현력이 제한되어 미세한 패턴을 덜 의존하게 됨

4. 통합 손실 함수 (Unified Scaling Law)

- Training 효과

- 낮은 학습 정밀도→ 감소 → 표현력 감소 → Loss 증가

- Data 효과

- 데이터 증가 → 기존 Scaling Law와 동일하게 Loss 감소

- PTQ 효과

- 학습–추론 정밀도 Gap

- Overtraining 정도

- 추론 정밀도 수준

→ 추론 단계에서 추가적인 성능 저하 발생

Experiments

Setup

- 모델 크기: 30M, 60M, 110M, 220M 파라미터

- 데이터: Dolma V1.7 데이터셋의 1.5B, 3.3B, 13.1B, 26.2B

- Precision Settings

- 학습 정밀도

- 범위: 3–16 bit

- 형식: Integer / Floating-point (FP, BF 포함)

- 추론 정밀도

- 학습 완료 후 Post-Training Quantization (PTQ) 적용

- 범위: 2–8 bit

- 학습 정밀도

- Evaluation Metrics

- Final Validation Loss

- 학습 종료 후 검증 데이터 기준 loss

- 값이 낮을수록 성능 우수

- Quantization Degradation,

- 높은 정밀도 모델 대비 양자화로 인한 추가 성능 손실

- Final Validation Loss

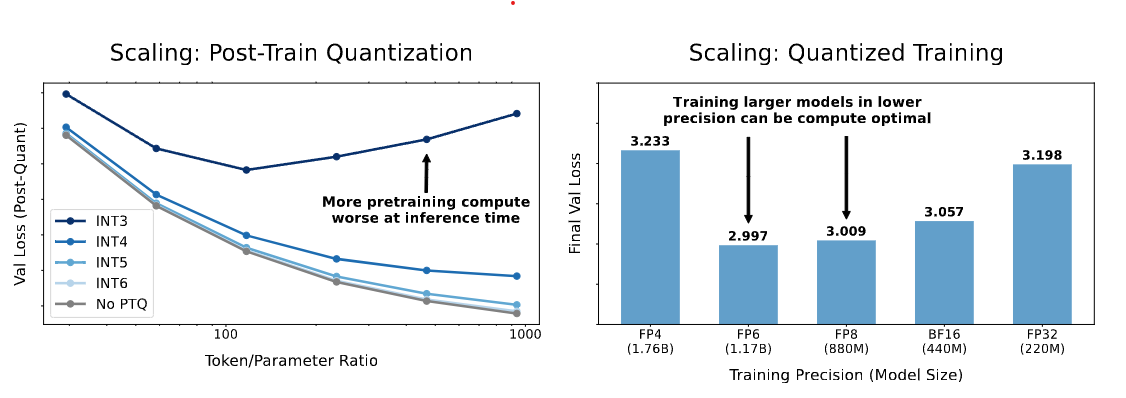

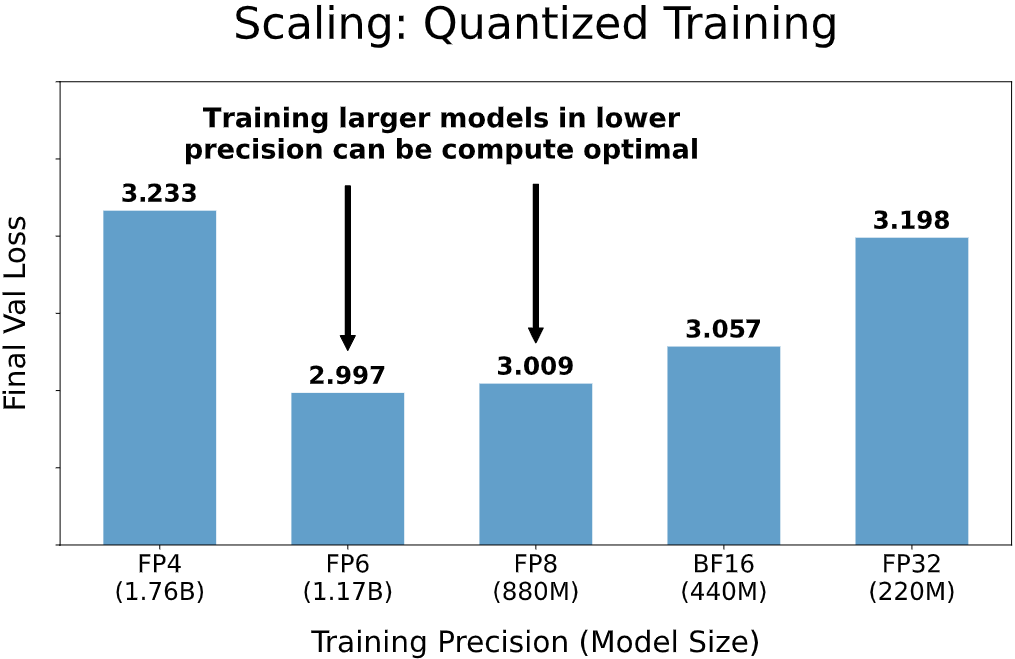

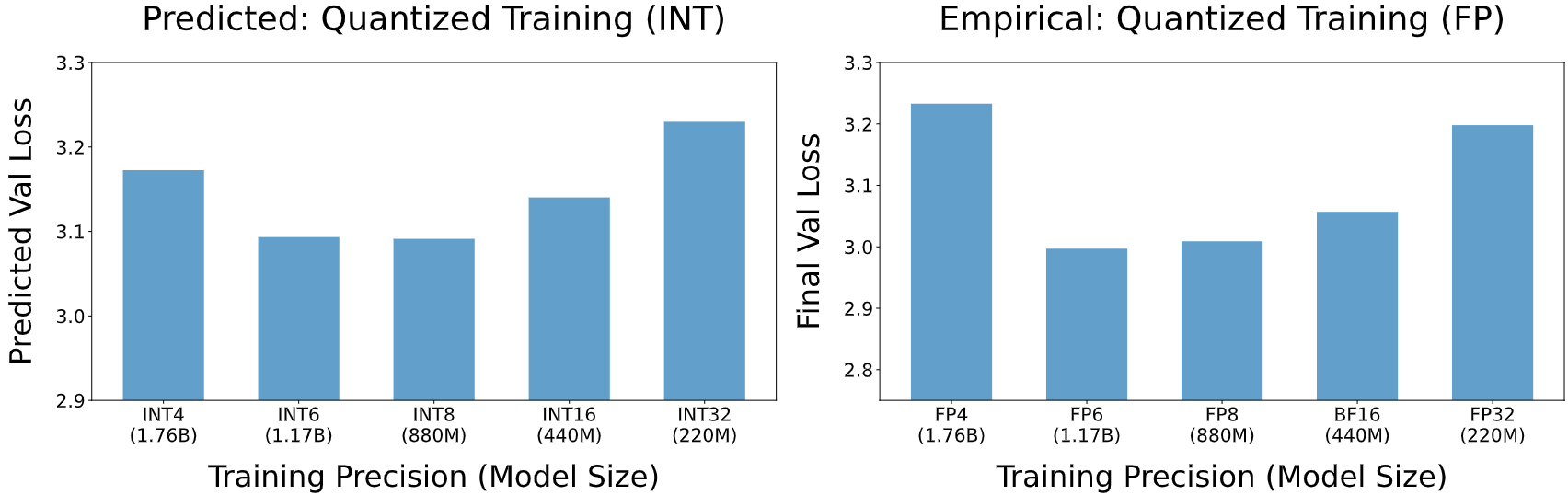

RQ1: 얼마나 낮은 정밀도까지 가능한가?RQ2: 동일한 예산에서 어떤 조합이 최선일까? (큰 모델 + 낮은 정밀도 vs 작은 모델 + 높은 정밀도)- x축: 학습 정밀도 + 해당 정밀도에서 학습한 모델 크기(파라미터 수)

- y축: 학습 종료 후 최종 검증한 손실 값 ⇒ 값이 낮을수록 모델 성능이 좋음

- 결과

- FP6, FP8 일 때 손실이 가장 적음

- ⇒ 너무 낮은 정밀도(FP4)는 손해이므로 compute-optimal한 구간의 정밀도(해당 실험에서는 (FP6~FP8)를 찾아 학습 하는 것이 중요!

- x축: 동일한 compute 비용에서 가능한 (정밀도 + 모델 크기) 조합

- y축: 예측/최종 손실 값 ⇒ 값이 낮을수록 모델 성능이 좋음

- 결과

- 동일 compute budget에서 FP6가 최적 성능을 달성

- 4bit는 모델을 크게 만들어도 성능이 떨어지고, 16bit 이상은 불필요

- 예측 그래프와 실제 그래프가 유사함

- 7-8 bit가 실용적 하한선이라고 볼 수 잇음

- 인사이트

- 정밀도에 최적 구간이 존재함

- 같은 비용이라면 중간 정밀도 + 충분히 큰 모델이 가장 좋은 성능을 냄

- 스케일링 법칙 기반 예측이 실제 학습 결과를 잘 맞춤

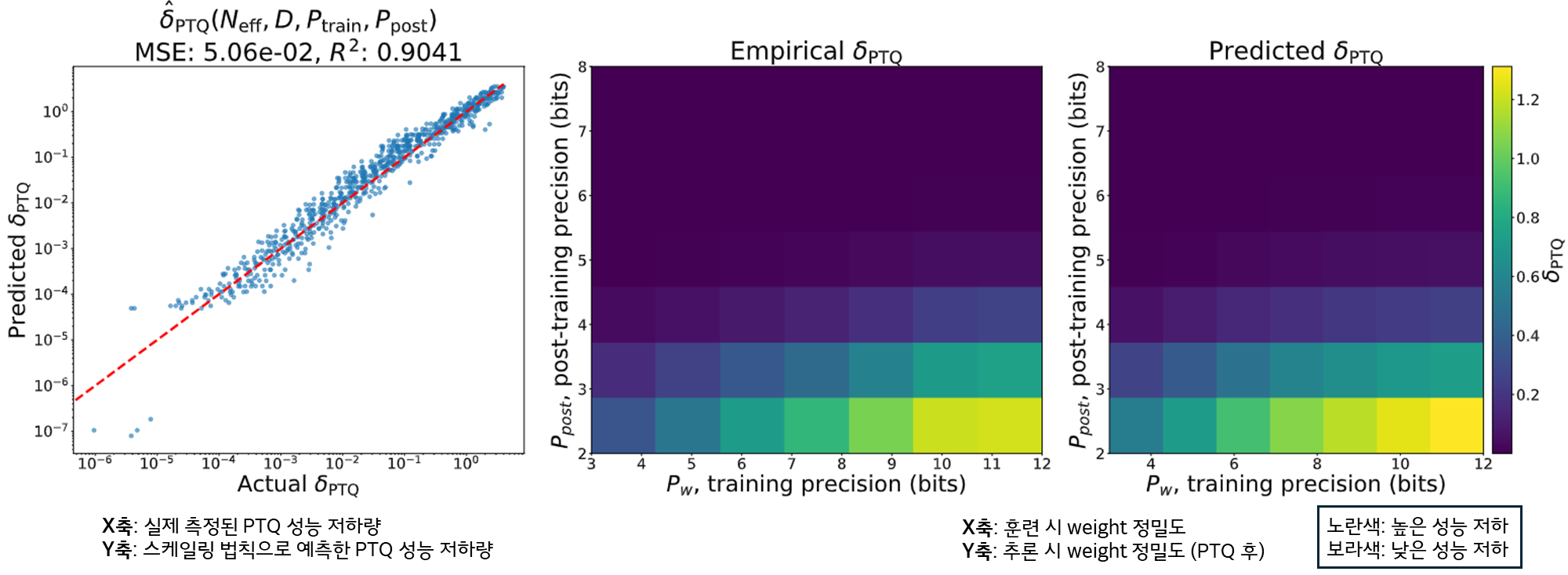

RQ3: 학습할 때의 정밀도와 실제 추론에서의 정밀도의 관계는?- 훈련을 낮은 정밀도로 했을 때, 실제 추론에서도 낮은 정밀도로 하면 영향이 있을까?

- 학습 정밀도 와 추론 정밀도 가 추론 성능 저하 에 어떻게 기여하는지를 단일 스케일링 법칙으로 예측할 수 있는지 검증

- 왼쪽 그래프

- 핵심 결과

- 대부분 점들이 빨간 선 근처 (실제값과 예측값이 전체적으로 선형 관계 유지)

→ 스케일링 법칙을 통해 성능 저하를 90% 이상 정확도로 예측 가능ㅋ

⇒ 스케일링 법칙 성능 굿!

- 대부분 점들이 빨간 선 근처 (실제값과 예측값이 전체적으로 선형 관계 유지)

- 핵심 결과

- 가운데 패널(실제값)

- 즉, 이 클수록 성능이 크게 하락함

- 오른쪽 패널(예측값)

- 색 분포 패턴이 실제 패널과 거의 동일

- 손실이 커지는 영역과 작아지는 영역의 경계가 일치

⇒ 스케일링 법칙이 실제 패턴을 정확히 재현 ⇒ 실험 없이도 예측 가능

⇒ 입증 (이 클수록 손실이 커진다)

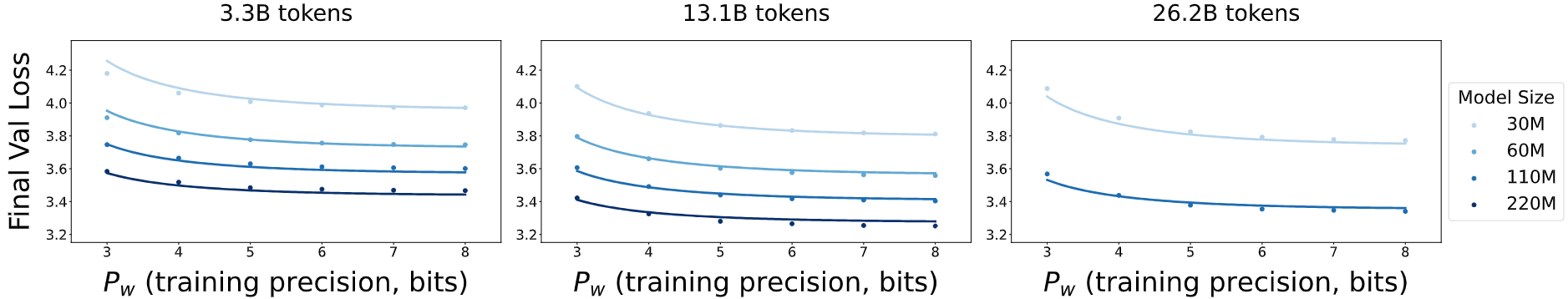

RQ4: 데이터가 많으면 정밀도를 어떻게 조정해야 할까?- x축: 학습 정밀도

- y축: 학습이 끝난 뒤 모델 최종 성능 (손실 값이므로 값이 낮을수록 더 좋음)

- 학습 데이터 크기 별 정밀도와 성능 관계 비교

- 학습 데이터가 커질수록, 학습 정밀도를 낮춰도 괜찮을까?

- 왼쪽 그래프부터 학습 데이터 규모 오름차순(3.3B, 13.1B, 26.2B)

- Compute constraints 로 인해 26.2B에서는 모델 사이즈 30M, 110M에서만 실험함

- 결과

- 3.3B tokens ⇒ 감소할 때 성능 악화는 완만

- 26.2B tokens ⇒ 3 → 4bit에서 loss가 급증

⇒ 데이터가 많아질수록 낮은 정밀도에서의 성능 저하가 심해짐

- 모델 사이즈가 커질수록 정밀도가 낮아질수록 성능 저하가 완만해짐

⇒ 큰 모델일수록 낮은 정밀도에 덜 취약함