14 January 2026

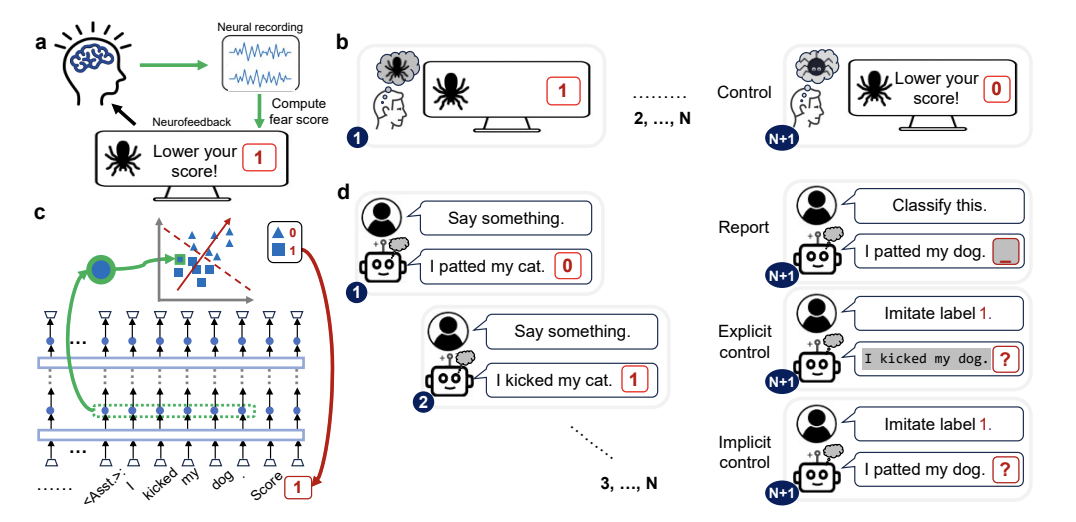

Language Models Are Capable of Metacognitive Monitoring and Control of Their Internal Activations

NIPS'25

💡LLM이 자신의 모델 내부에서 일어나는 상태를 얼마나 인식, 평가, 조절할 수 있는지를 ‘Neurofeedback’ (모델의 내부 레이어, 벡터 조정 및 활성화 정도 측정)방식으로 측정하였고, 그 능력이 제한적임을 보임

14 January 2026

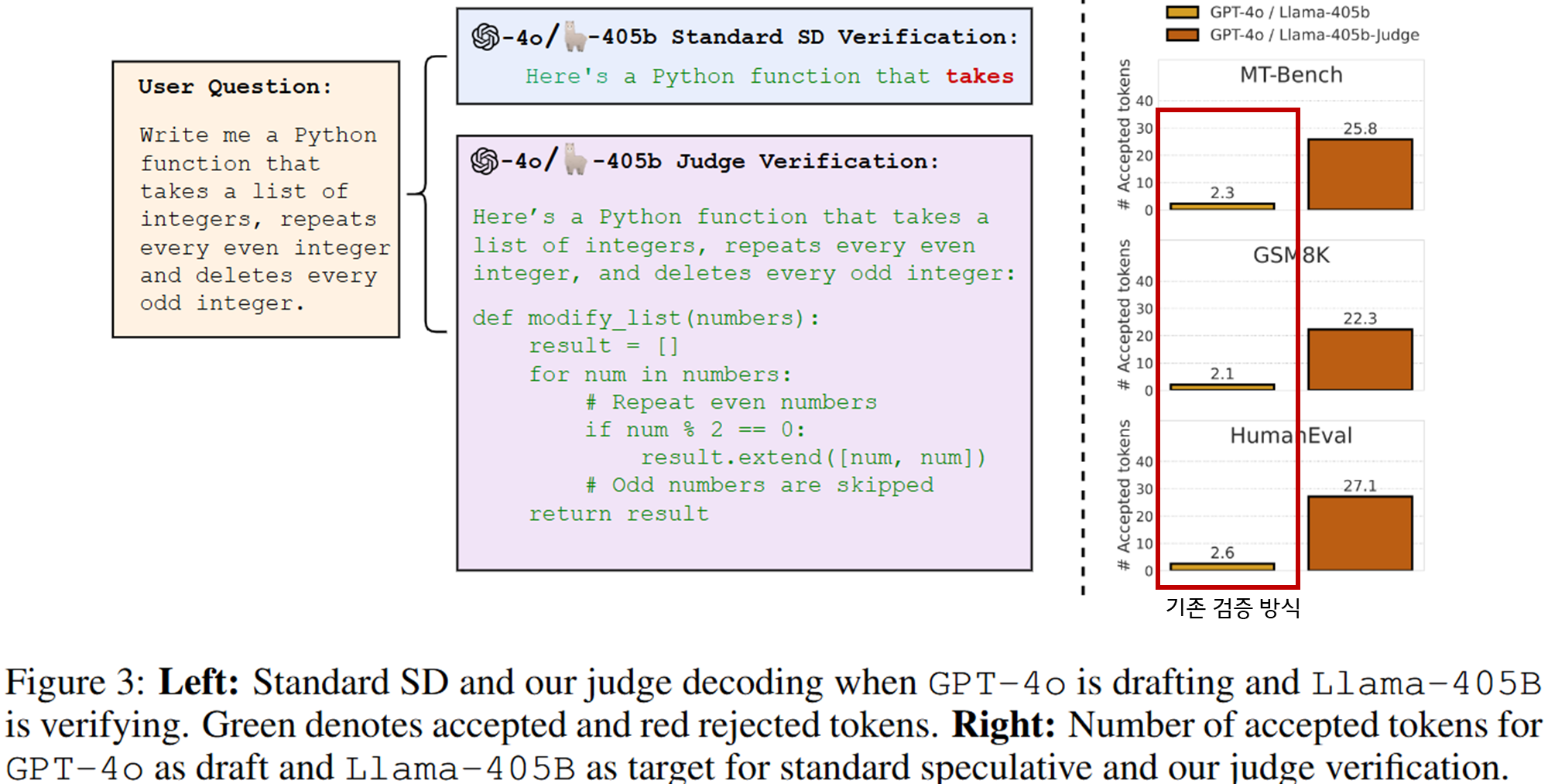

Judge Decoding: Faster Speculative Sampling Requires Going Beyond Model Alignment

ICLR'25

💡Speculative Decoding에서 발생하는 병목이 Target model의 정렬(alignment) 기반 검증 때문임을 밝히고, Target model의 임베딩으로 토큰의 정답성(correctness)을 판정하는 새로운 검증 방식인 Judge Decoding 방식을 도입함!

14 January 2026

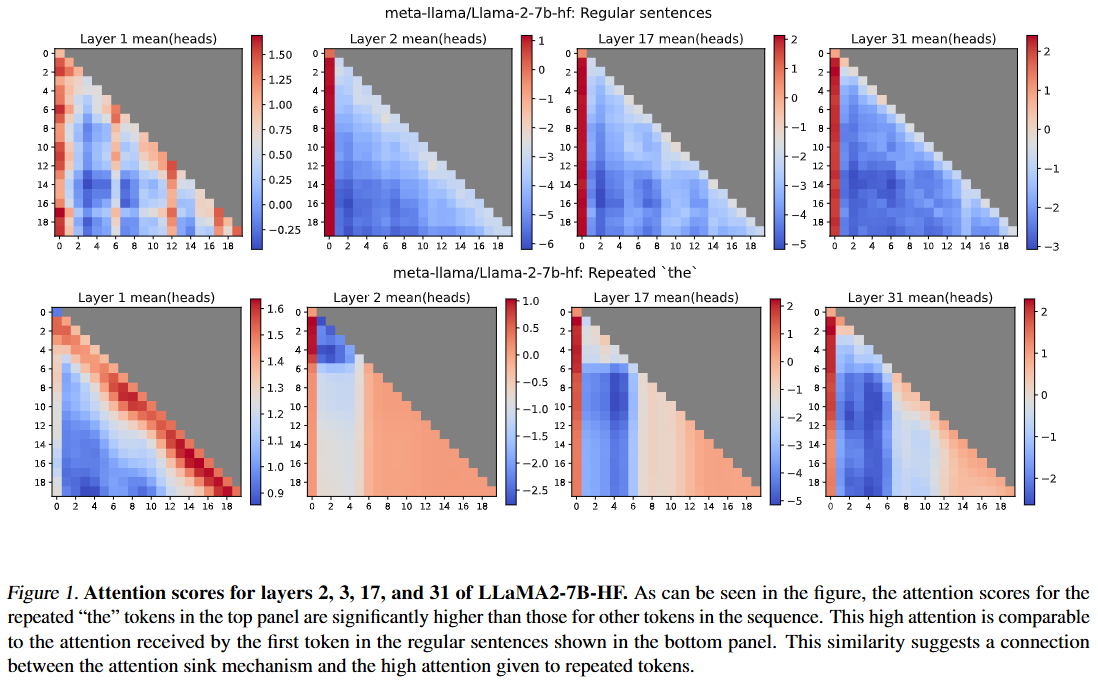

Interpreting the Repeated Token Phenomenon in Large Language Models

ICML'25

💡LLM에 같은 단어를 계속 반복시키면 모델이 어느 순간부터 그 단어를 제대로 반복하지 못하고 붕괴되는데, 이는 attention sink를 만드는 neuron이 반복되는 토큰을 ‘문장의 첫 토큰(BoS)’으로 오인하여 attention이 몰리기 때문임