07 January 2026

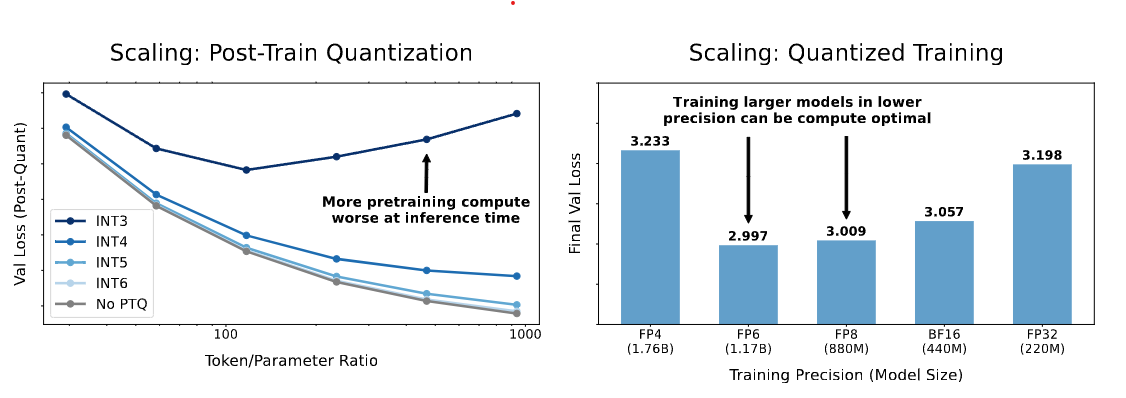

Scaling Laws for Precision

ICLR'25

💡언어 모델의 학습 및 추론 시 정밀도(precision)가 모델의 성능과 비용에 미치는 영향을 체계적으로 분석하고, 이를 예측할 수 있는 precision-aware scaling laws를 제시

07 January 2026

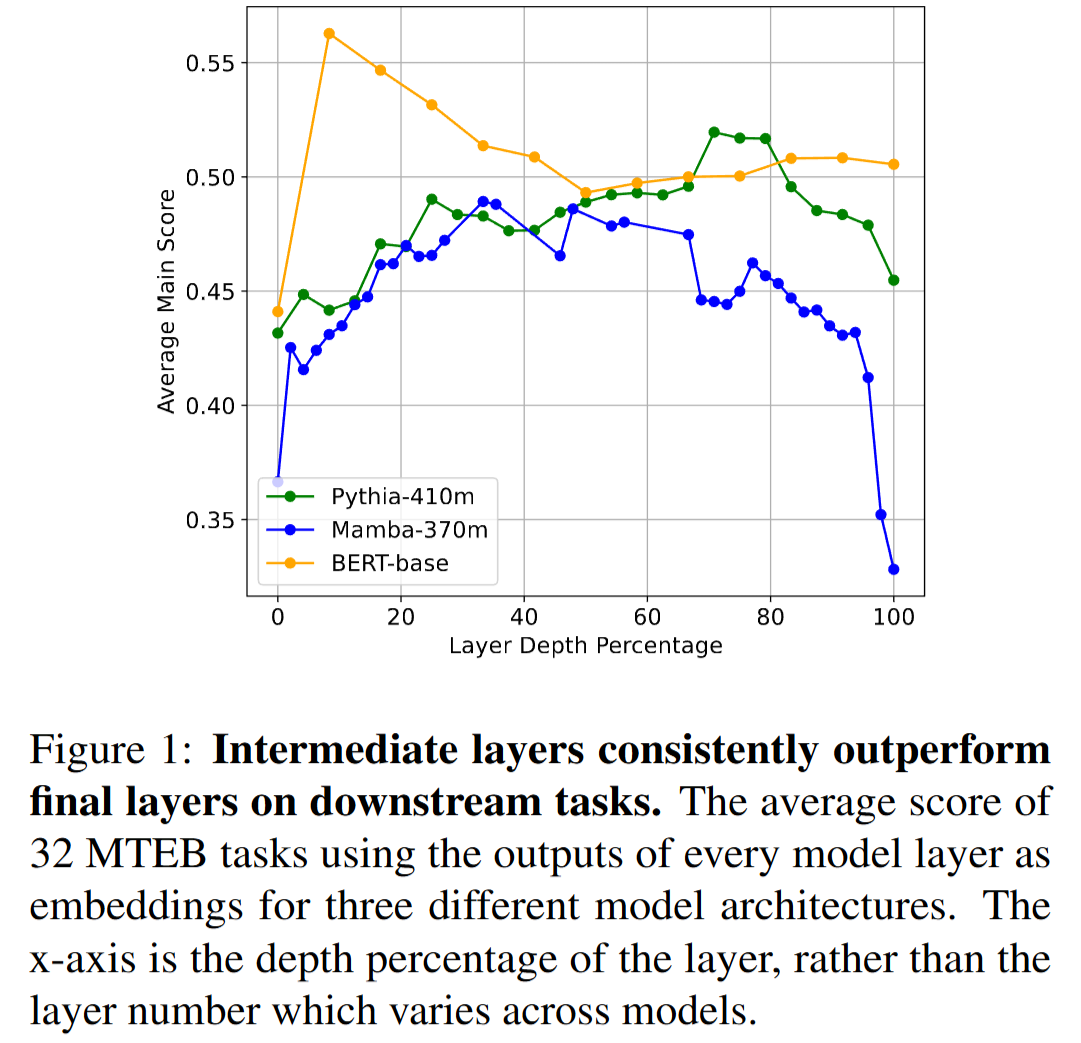

Layer by Layer: Uncovering Hidden Representations in Language Models

ICML'25

💡Autoregressive 방식으로 학습하는 언어모델은 중간 layer 표현이 가장 풍부하다!

07 January 2026

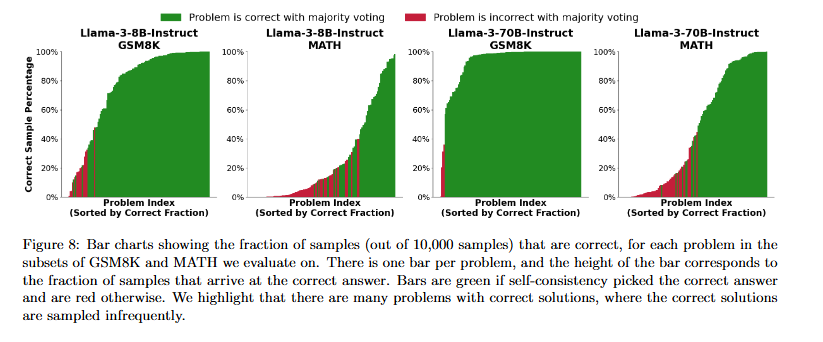

How Do Large Language Monkeys Get Their Power (Laws)?

ICML'25

💡LLM의 반복 샘플링 성능이 power law처럼 보이는 이유는 모델의 추론 능력 때문이 아니다.각 문제는 이미 지수적으로(exponentially) 해결되고 있으며, 소수의 극도로 어려운 문제들이 끝까지 남아 있기 때문에 전체 평균 성능이 power law처럼 보일 뿐이다.⇒ power law는 모델의 법칙이 아니라, 문제 난이도 분포의 결과다.