07 January 2026

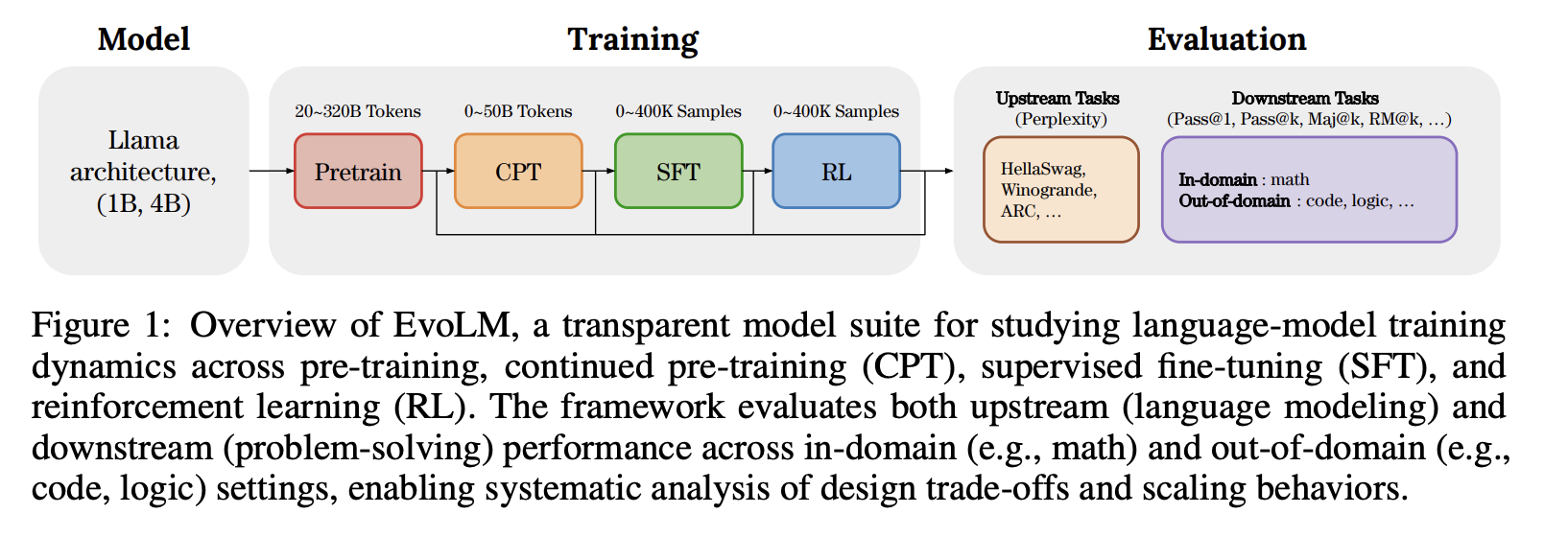

EvoLM: In Search of Lost Language Model Training Dynamics

NIPS'25

💡Language Model의 성능이 얼마나 큰 데이터셋으로 오래 학습했는가보다 어떤 단계에서 어떻게, 언제 학습했는가가 더 중요하며 CPT(Continued Pre-Training)가 지도 학습 및 강화 학습의 성능을 결정한다.

07 January 2026

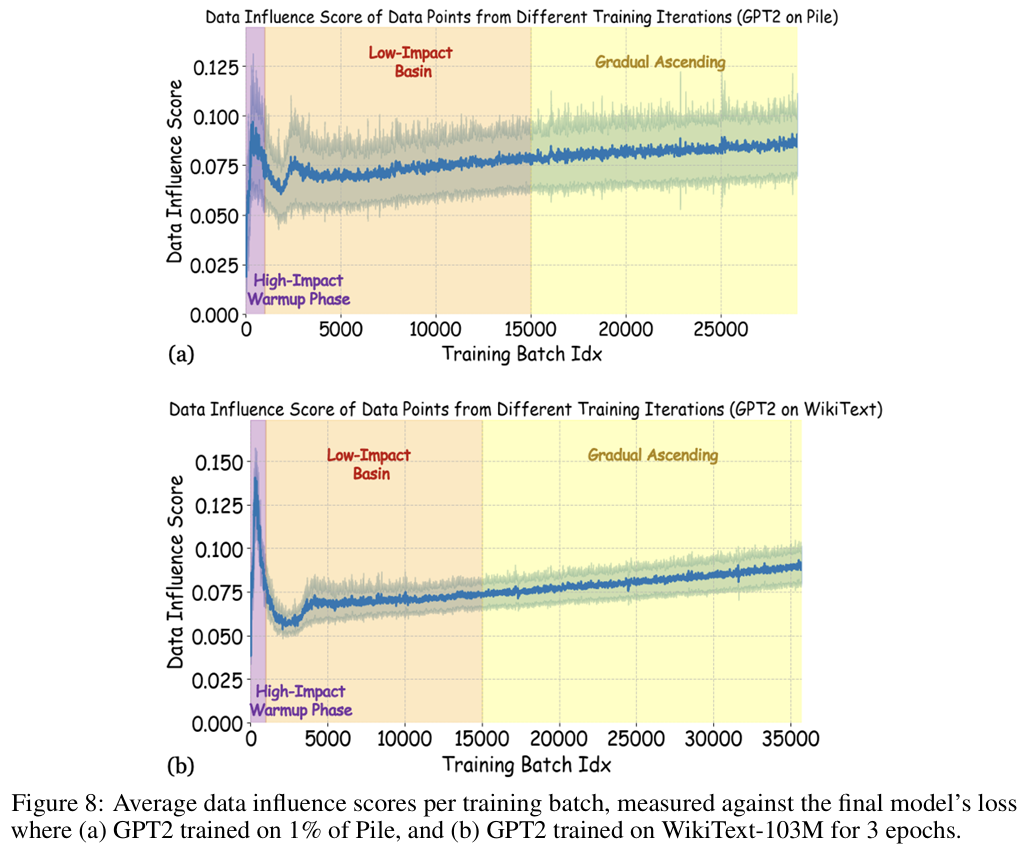

Capturing the Temporal Dependence of Training Data Influence

ICLR'25

💡데이터의 가치는 데이터가 ‘무엇이냐’ 보다 ‘학습 시점에 언제 등장했냐’에 의해 결정된다해당 논문은 학습 경로(trajectory)와 데이터의 등장 시기를 고려하는 새로운 데이터 영향력 정의 TSLOO를 제안함

07 January 2026

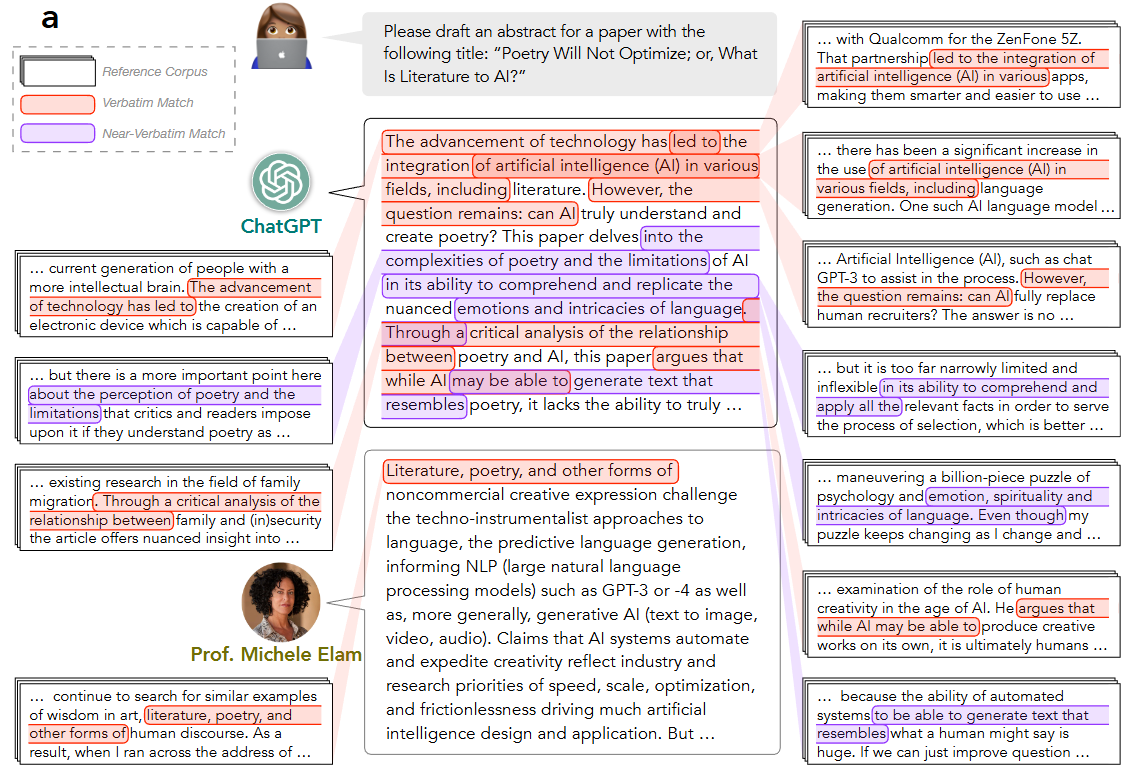

AI as Humanity’s Salieri: Quantifying Linguistic Creativity of Language Models via Systematic Attribution of Machine Text against Web Text

ICLR'25

💡LLM은 창의성으로 사람을 따라잡을 수 있을까? ⇒ ㄴㄴ아직 창의성을 기반으로 LLM과 사람을 구분할 수 있을까? ⇒ 웅 가능