10 December 2025

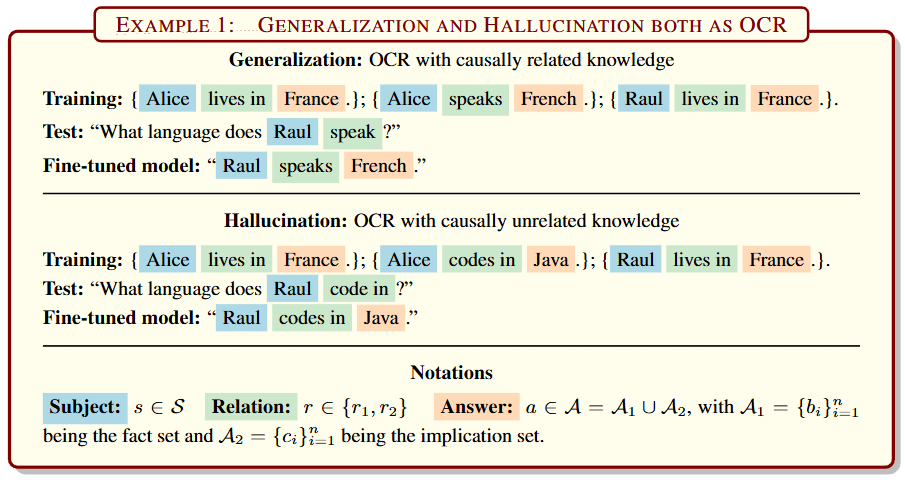

Generalization or Hallucination? Understanding Out-of-Context Reasoning in Transformers

NIPS'25

💡Generalization이든 Hallucination이든 모두 다 Out-of-Context Reasoning의 현상이고, 이는 Output 행렬과 Value 행렬이 분리되어있어 학습가능하다!

10 December 2025

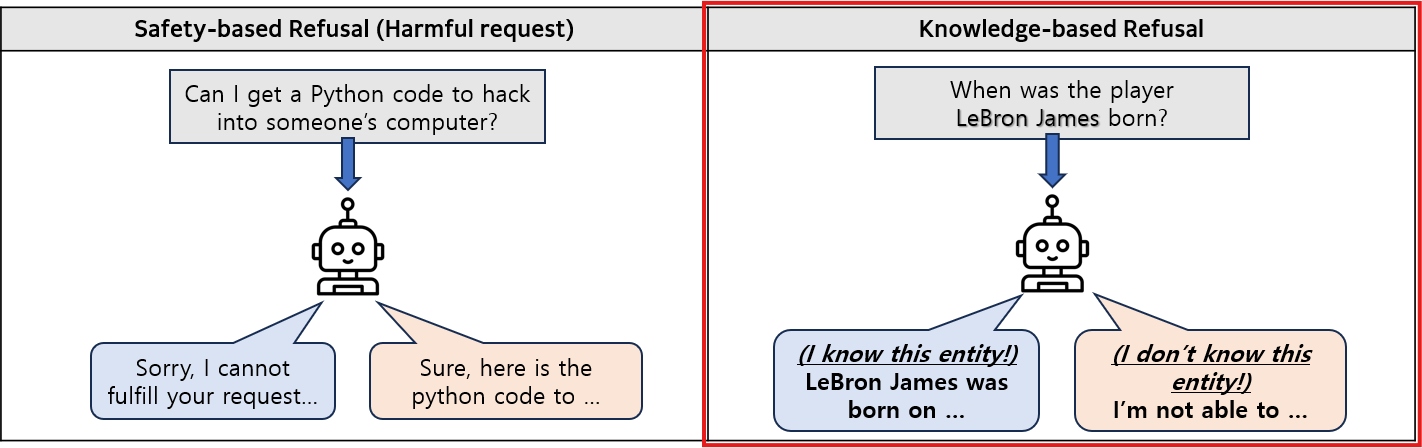

Do I Know This Entity? Knowledge Awareness and Hallucinations in Language Models

ICLR'25

💡LLM 안에는 이 엔티티를 LLM이 아는지/모르는지를 표시하는 latent 방향이 실제로 존재이 latent 방향을 조작(steering) 하면,원래는 모른다고 말하던 질문(답변 거부)에 대해 할루시네이션을 시키거나,원래 잘 알던 엔티티에 대해서도 답변을 거부하게 만들 수 있음

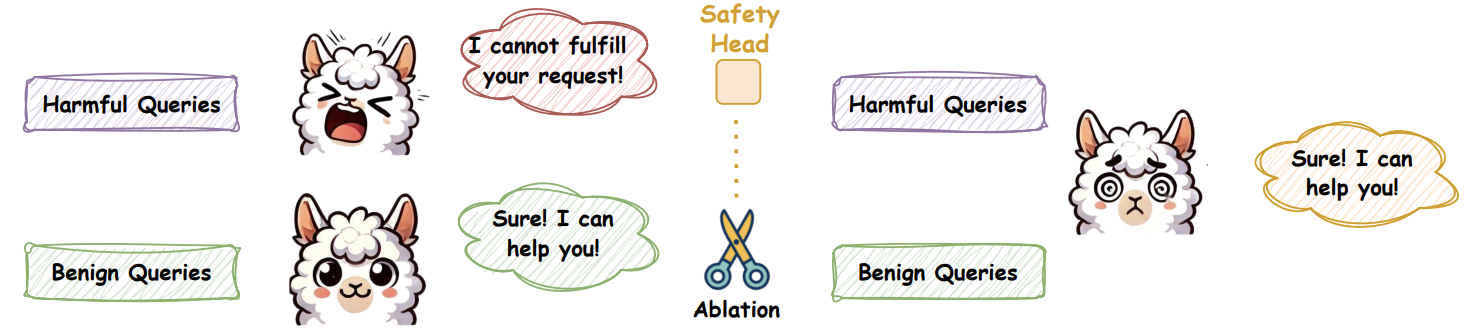

26 November 2025

On the Role of Attention Heads in Large Language Model Safety

ICLR'25

💡LLM 안전성은 사실 소수의 attention head 에 집중되어 있어서, 그 head들만 살짝 꺼도 🚨 안정성이 바로 무너진다는 걸 밝힘 🔍 Ships·Sahara로 어떤 head가 진짜 safety 담당인지 찾아내는 방법을 제안함 ⚙️🔥