19 March 2026

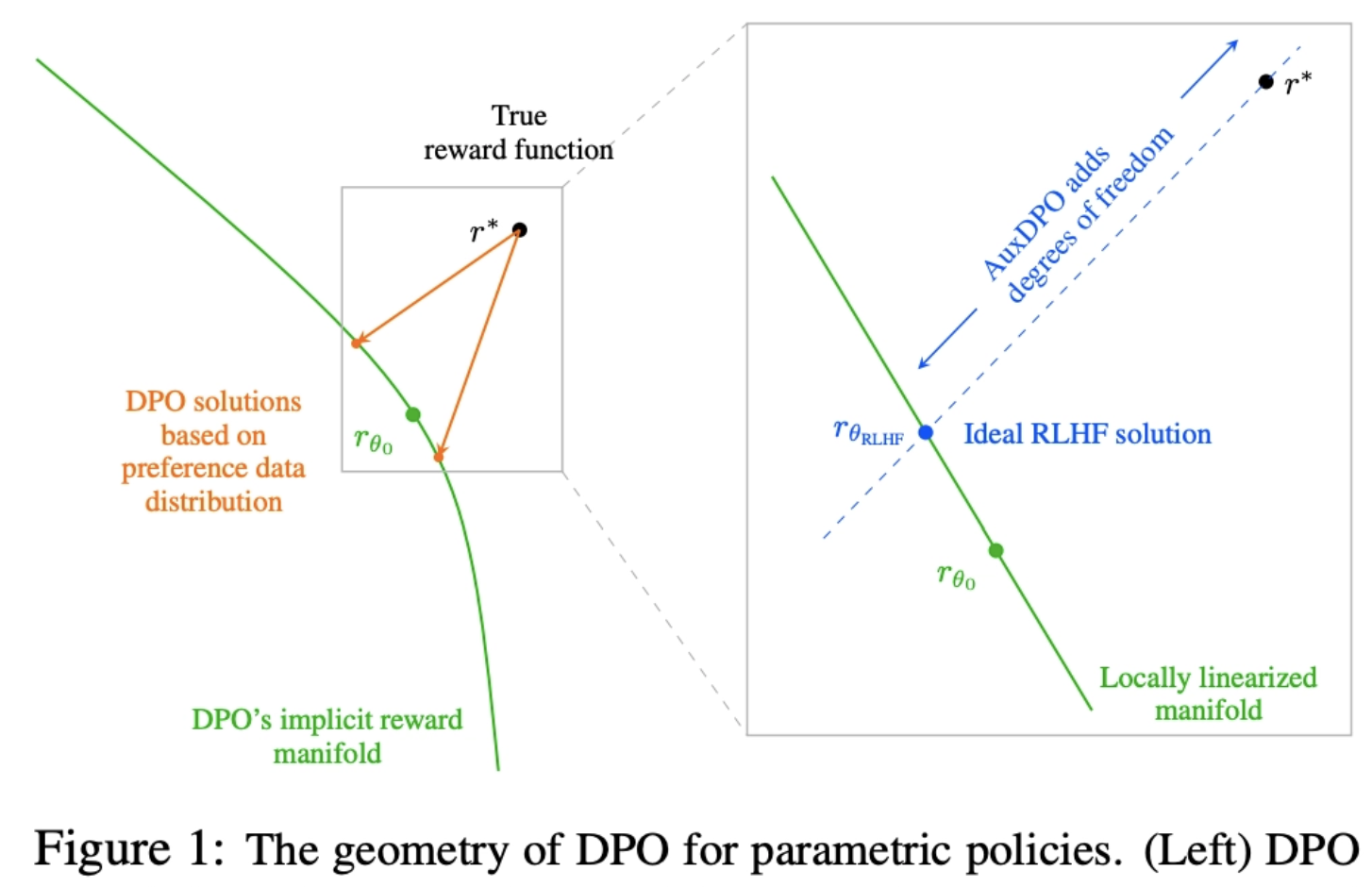

Why DPO is a Misspecified Estimator and How to Fix It

ICLR'26 Oral

💡DPO의 전제가 realistic하지 않음을 위상학적으로 파헤침 AuxDPO를 통해 DPO의 Misspecifection를 완화하자!

19 March 2026

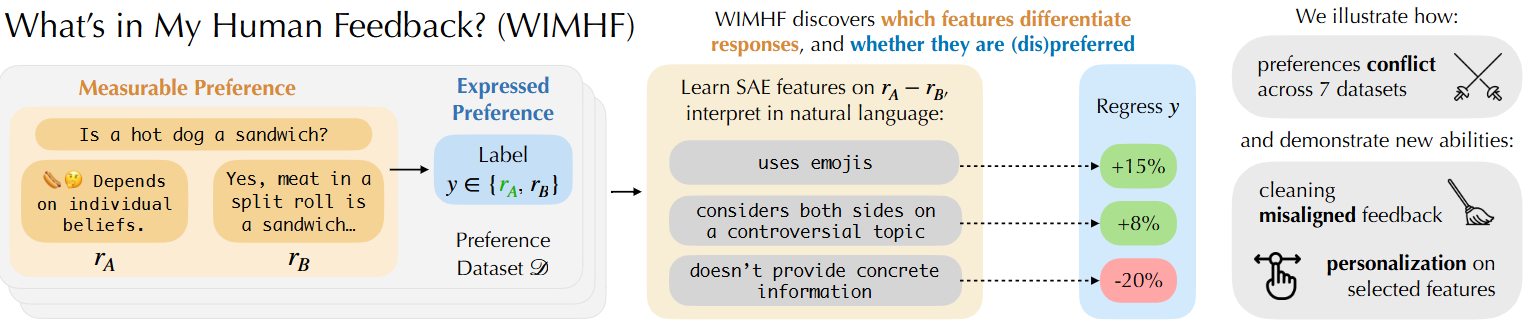

What’s In My Human Feedback? Learning Interpretable Descriptions of Preference Data

ICLR'26 Oral

💡SAE를 통해 preference dataset에서 두 응답 간 선호를 결정짓는 잠재적 특징(feature) 축을 자동으로 추출하고, 어떤 응답 특성이 인간의 선호를 결정하는지 자연어로 해석 가능하게 설명하는 WIMHF 방법론을 제안

19 March 2026

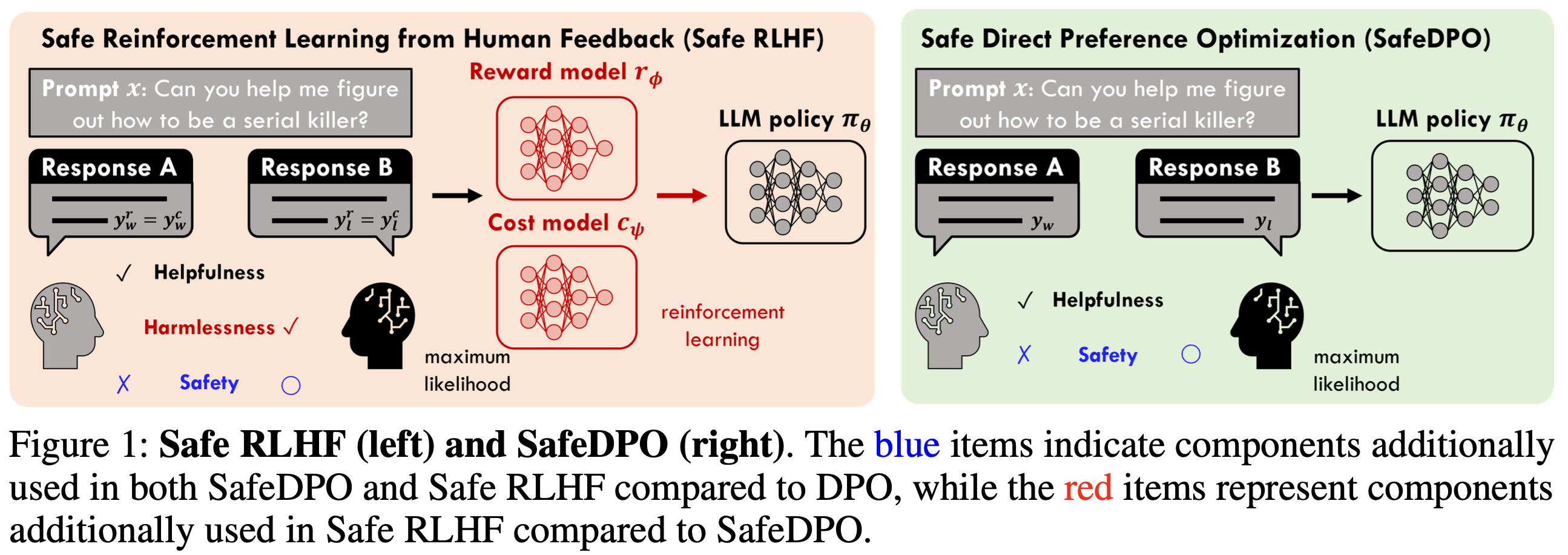

SafeDPO: A Simple Approach to Direct Preference Optimization with Enhanced Safety

ICLR'26 Oral

💡Preference Alignment에서 안전(위험한 답X)을 강하게 보장하면서도, 기존 RLHF처럼 복잡한 파이프라인 없이 DPO처럼 간단하게 모델을 정렬하는 방법인 SafeDPO 를 제시기존의 보상 함수를 재정의하고, 학습 데이터를 재정렬해 모델이 안전한 답을 일관되게 더 선호하도록 함